@derGhostrider

20% war eine Schätzung basierend auf dem realen Zuwachs an Spieleleistung, den eine rtx Titan erzielte. Es könnten auch 15% sein, klar. 10% halte ich aber im Vergleich für zu niedrig, weil die 3090 zur 3080 deutlich mehr Reserven hat, als die rtx Titan zur 2080 ti. Alles Weitere werden die bald kommenden Tests zeigen.

Ja, die Tests werden es zeigen. Auf die 10 bis 15 Prozent Vorsprung komme ich auch nur, da die 3090 mehr Reserven hat - die alte Titan war ja nur ~5% schneller.

nVidia macht ca. 65% seines Umsatzes mit Systemen für "exotische Produktivsoftware". Von da aus betrachtet sind Gamer die Exoten

Hier im Forum in einem Thread über Gaming-Grakas triffst Du auf wieviele Personen, die in diese Kundengruppe gehören? Richtig.

Spaß beiseite, wenn du eine Szene lädst, die 25 GB Texturen brauchst, gehen die nicht in den 10 GB Vram.

<klugscheißmodus>Die Karten haben exakt 0MB VRAM. VRAM ist ein eigener Speichertyp, der seit vielen Jahren nicht mehr hergestellt wird. Die Karten verfügen über GDDR6X RAM. Kein VRAM.</klugscheißmodus>

Mir ist natürlich klar, was Du meinst. Da VRAM jedoch einfach ein "besserer Speichertyp" ist (und auch mit DoubleDataRate-Technologie hätte ausgestattet werden können, wodurch wir heute deutlich schnelleren Speicher hätten), versuche ich immer mal wieder den Leuten beizubringen, dass VRAM schlicht und ergreifend in diesem Kontext falsch ist.

Je nach Software wird die Szene erst garnicht gerendert oder aber sie versucht, den PC-Ram als Cache zu verwenden, der um einige Potenzen langsamer ist.

Nicht "um einige", sondern um eine.

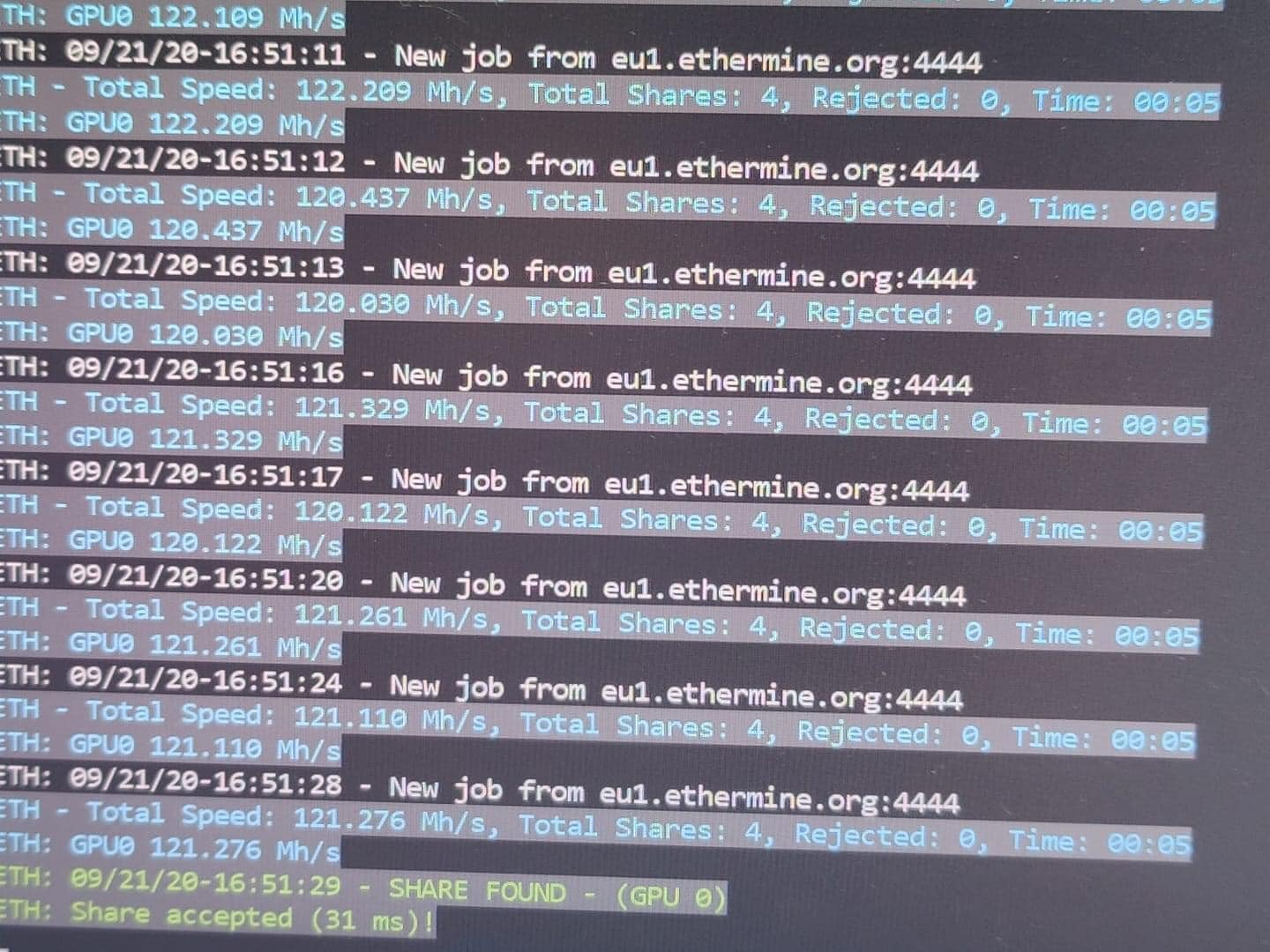

Schnell gegoogelt: Ryzen2700X mit DDR4-3733 CL19-19-19-40 kommt im AIDA 64 Read auf knapp 53GB/s. 3080 = 760 GB/s. Das ist eine Größenordnung.

Ich möchte allerdings auch darauf verweisen, dass bis letztens in den "normalen" Desktop-Karten 11 GB das Limit waren. Eine Software, die mit 10 oder 11 GB einfach "gar nichts" anzeigt, halte ich für fehlerhaft oder sehr extrem optimiert. Hast Du dafür ein Beispiel?

Also falls möglich, nur mit erheblichen Geschwindigkeitseinbußen. Hier gilt also: Mehr Vram gleich besser und schneller. Und ja, die neuen Genereationen seit Turing sind um eines besser als Pascal. Steht doch alles in dem Test der 3080 von Igor. Lies den einfach mal in ruhe durch.

Den Artikel habe ich schon lange gelesen. *schulternzuck* Da gab es keine Überraschungen. Vor allem auch nichts, was mit 10 GB nicht hätte funktionieren können.

Natürlich ist mehr RAM meistens auch besser - zumindest nicht schädlich. Wobei es auch das bereits häufig genug gab... Meine betagte Graka, die durch eine 3080 ersetzt werden wird, hat nicht einmal annähernd soviel RAM und trotz all der Kommentare hier, die suggerieren, dass man solch eine Karte nur mit 20GB benutzen könne, kann ich sogar mit dem alten Klotz 4k Spiele (mit miesen Frameraten) darstellen. Und das liegt nicht primär am RAM, dass es langsam ist, sondern einfach an der GPU, die aus dem letzten Loch pfeift.

Daher sehe ich das auch eher entspannt mit den 10 GB: Viel besser, als das, was ich jetzt habe. Vergleichbar mit der 2080er-Generation, bei der ich mich nicht erinnern könnte gelesen zu haben: "OH GOTT, SO WENIG SPEICHER!" - was auch komisch wäre bei der Menge.

Ja, mit anderer Speicheranbindung so ca 16 GB hätte ich jetzt auch netter gefunden. Jedoch eher mit der Zukunft im Hinterkopf und der Befürchtung, dass immer verschwenderischer mit RAM umgegangen wird.

Naja, da ich die Eröffnungsangebote verpasst habe und mich nicht von einigen Zwischenhändlern über's Ohr hauen lassen möchte, warte ich jetzt eh erstmal noch auf Tests und eine Normalisierung der Preise/Verfügbarkeit. Im Worst-Case gibt's dann schon die Nachfolgerkarten. ^^

Oder ich kaufe zwischendurch eine 3090, dann ist das Thema auch durch.

Ist ja auch nur eine Graka. Kein Grund sich verrückt zu machen.