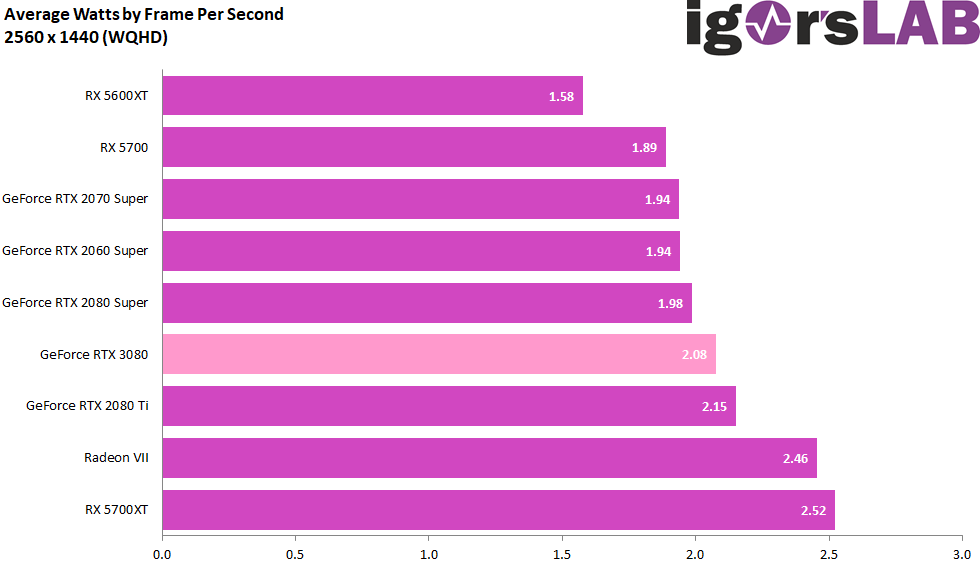

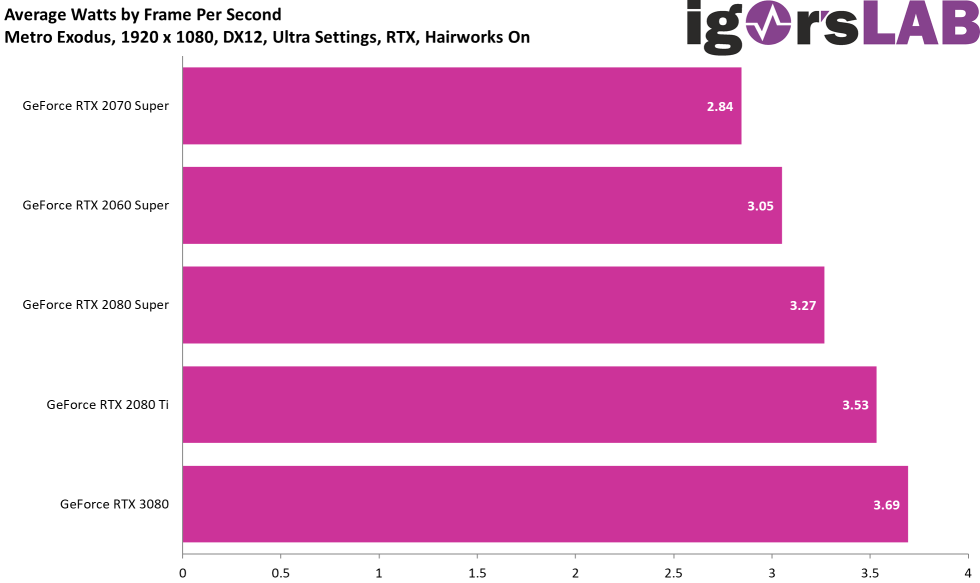

Um die Effizienz wirklich sauber beurteilen zu können, habe ich für jeden einzelnen Benchmark, dessen Ergebnisse wir ja schon kennen, auch die Leistungsaufnahme detailliert gemessen, die wir im Detail auf der vorigen Seite ebenfalls schon sehen konnten. Doch was erwartet uns, wenn wir die beiden Werte nun sinnvoll zueinander ins Verhältnis setzen? Wieviel Watt an Leistungsaufnahme kostet mich ein einzelner Frame pro Sekunde (mehr oder weniger)? Die Erkenntnis ist durchaus verblüffend.

Spiele wie Horizon Zero Dawn und Wolfenstein Youngblood, die mit der GeForce RTX 3080 auch besonders gut skalieren, sind ab WQHD der beste Indikator dafür, wie es läuft, wenn es denn läuft. World War Z habe ich eigentlich nur als Spiel mit dazugenommen, weil es das CPU-Limit in jedem Fall garantiert. Und genau dann, aber auch nur dann, wird die GeForce RTX leider reichlich abgestraft. Das ist wie im zweiten Gang und 50 mit 50 km/h durch die Stadt zu fahren. Prost in Richtung Tank oder Akku! Nur kann die Karte ja nichts dafür.

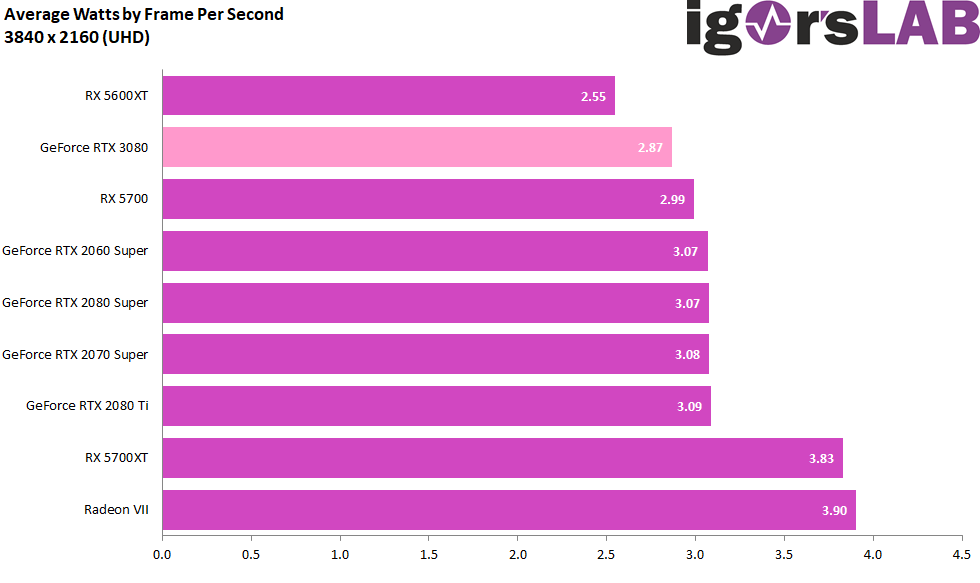

Das kann man nun für alle Spiele zusammenrechnen und ein kumuliertes Ergebnis ausweisen:

In Ultra-HD fällt diese Bremse bis auf World War Z und Assasin’s Creed Odyssey weg und siehe da, die GeForce RTX 3080 ist immer auf den vordersten Plätzen mit dabei und hängt in manchen Spielen den Rest sogar deutlich ab. Assassin’s Creed Odyssey wäre übrigens auch kein Thema, würde man auch in Ultra-HD auf “Extrem Hoch” spielen. Dann sieht das Ganze auch wieder ganz anders aus, weil die CPU nicht in den Wahnsinn getrieben wird und durchhängt. Im Übrigen machen auch die älteren Turing-Karten Keine allzu schlechte Figur.

Auch hier habe ich noch einmal alles zusammengezählt und siehe da, die GeForce RTX 3080 erweist sich plötzlich als recht effiziente Ultra-HD, weil der Rest im Feld einfach schlappmacht. Und mit der Radeon RX 5600 gewinnt man außer einem grünen Band am Sweetspot nichts, weil alles kaum noch sinnvoll spielbar ist.

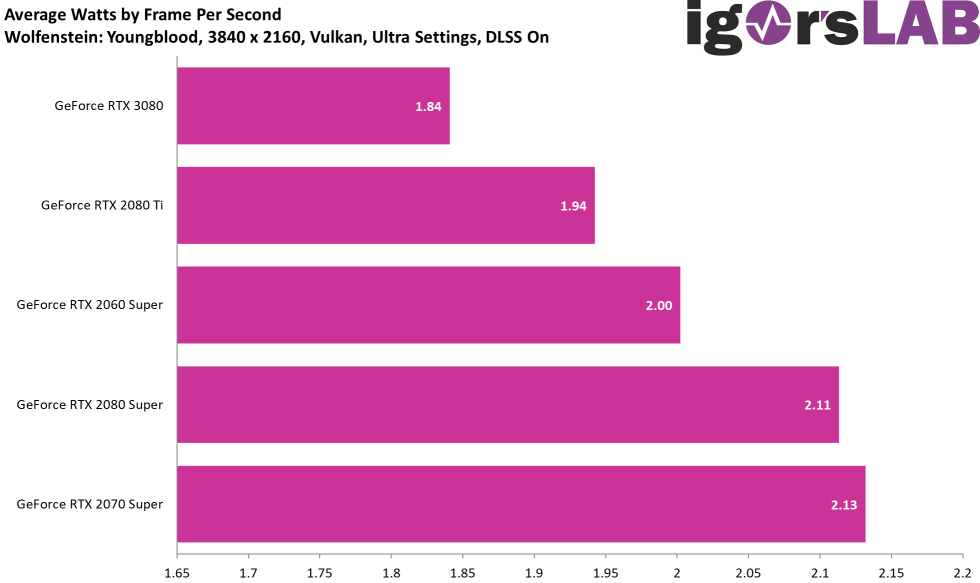

Energie sparen mit DLSS? Das klappt!

Machen wir mal ein kleines Experiment. Ihr stellt in der Galerie oben bei Ultra-HD einmal Wolfenstein Youngblood ein. Jetzt vergeichen wir mal das Ganze mit den Werten, die ich für Ulktra-HD, aber mit DLSS messen konnte. Waren es bei der GeForce RTX 3080 ohne DLSS noch 2.35 Watt pro FPS, die man aufwenden musste, sind es jetzt nur noch 1.84 Watt, also nur noch 78.3%. Dieser Zugewinn ergibt sich hier im Test natürlich nicht durch eine sinkende Leistungsaufnahme bei identischen FPS, sondern durch die gesteigerte Grafikperformance bei nahezu gleicher Leistungsaufnahme.

Entsprechende Artikel, die ich schon veröffentlicht habe zeigen allerdings, dass man mit Einsatz eines passenden Limiters genau diesen Effekt in Richtung Leistungsaufnahme kehren kann. begrenzt man den Run mit DLSS nämlich auf die FPS-Zahl ohne DLSS, dann sinkt die Leistungsaufnahme um fast 20%.

- 1 - Einführung und Testsystem

- 2 - Teardown, Platinenanalyse und Kühler

- 3 - Grafik-Performance: WQHD und Full-HD mit RTX On

- 4 - Grafik-Performance: Ultra-HD mit und ohne DLSS

- 5 - FPS, Perzentile, Frame Time & Varianzen

- 6 - Frametimes vs. Leistungsaufnahme

- 7 - Workstation: CAD

- 8 - Studio: Rendering

- 9 - Studio: Video- und Bildbearbeitung

- 10 - Leistungsaufnahme: GPU und CPU in allen Spielen

- 11 - Leistungsaufnahme: Effizienz im Detail

- 12 - Leistungsaufnahme: Übersicht & Netzteil-Empfehlung

- 13 - Temperaturen und Infrarot-Tests

- 14 - Geräuschemission / Noise

- 15 - NVIDIA Broadcast - Mehr als nur eine Spielerei?

- 16 - Zusammenfassung. Features und Fazit

Kommentieren