Gigabyte tritt momentan gleich mit zwei GeForce GTX 1080 am Markt an, wobei uns (vorerst) nur die Gigabyte GeForce GTX 1080 G1 Gaming zur Verfügung stand.

Gigabyte tritt momentan gleich mit zwei GeForce GTX 1080 am Markt an, wobei uns (vorerst) nur die Gigabyte GeForce GTX 1080 G1 Gaming zur Verfügung stand.

Die GeForce GTX 1080 XTreme Gaming wurde zum aktuellen Zeitpunkt nicht besampelt, befindet sich aber nunmehr auch auf dem Weg in die Redaktion und wird im Rahmen dieses Roundups ebenfalls vollumfänglich getestet.

Wir werden dies also im Rahmen unserer üblichen Testabläufe nachholen, wenn uns diese Karte erreicht hat. Dies wäre sicher auch deshalb um so interessanter, weil die G1 Gaming ja eher das etwas einfacher gehaltene Volumenmodell darstellt.

Äußerer Aufbau und Anschlüsse

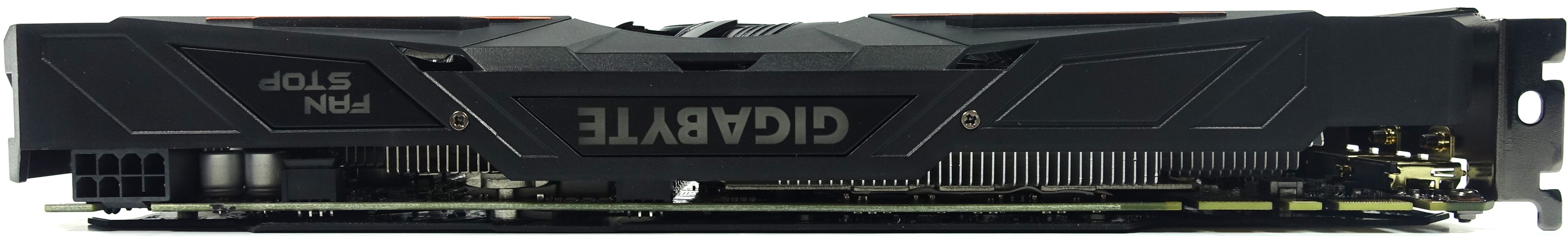

Die Kühlerabdeckung besteht komplett aus relativ dünnen Kunststoff und fasst sich auch lange nicht mehr so wertig an wie die Leichtmetallabdeckungen der Vorgängermodelle mit dem Windforce-Kühler. Dafür ist die Karte erfreuliche 871 Gramm leicht, jedoch 28,4 cm lang, 11 cm hoch und die für ein Dual-Slot-System üblichen 3,5 cm tief.

|

|

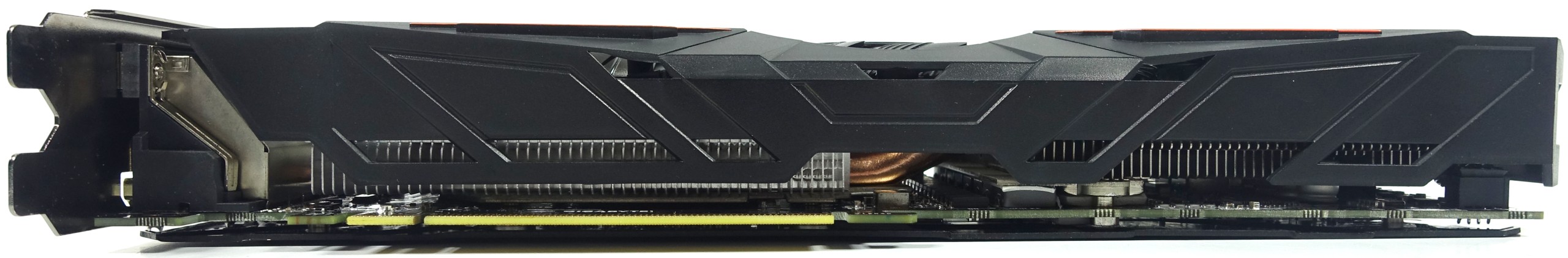

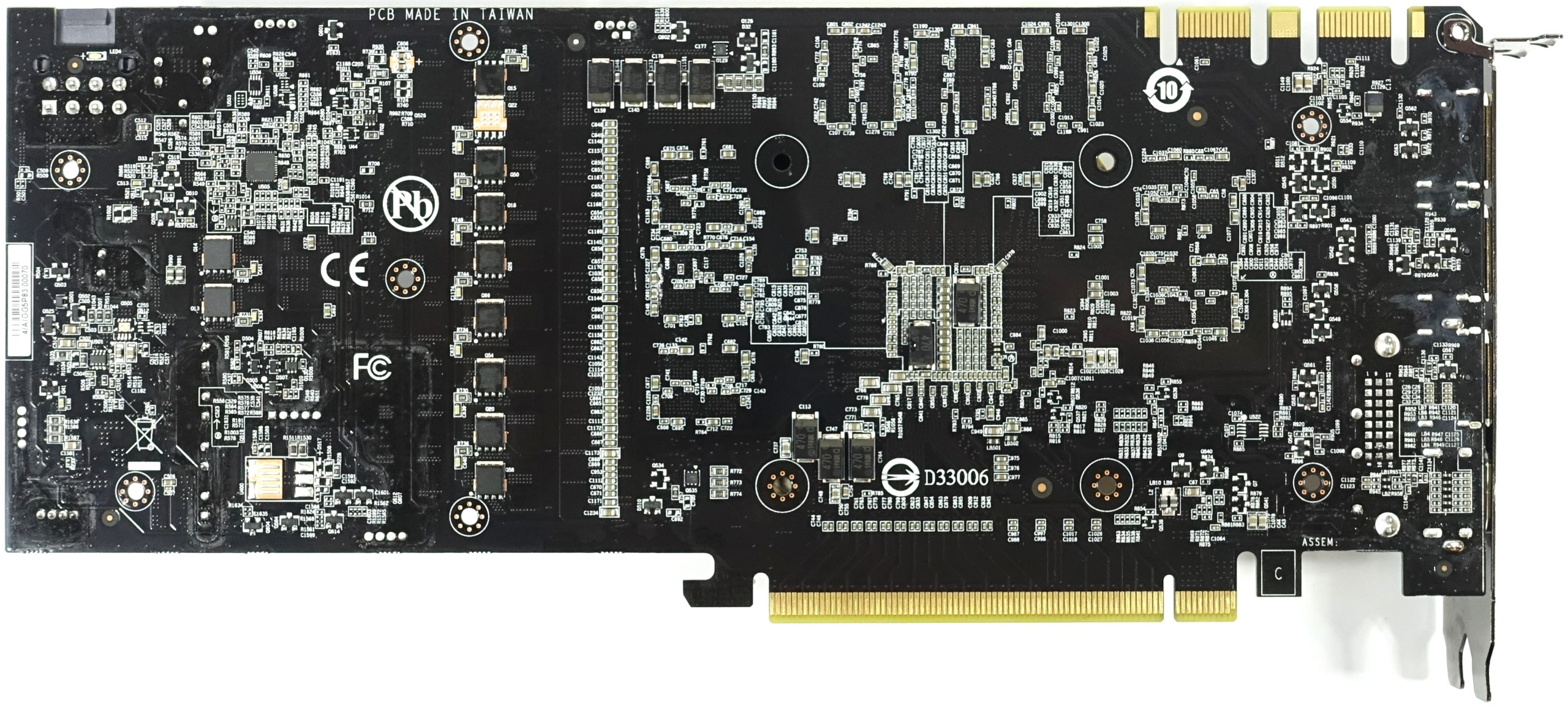

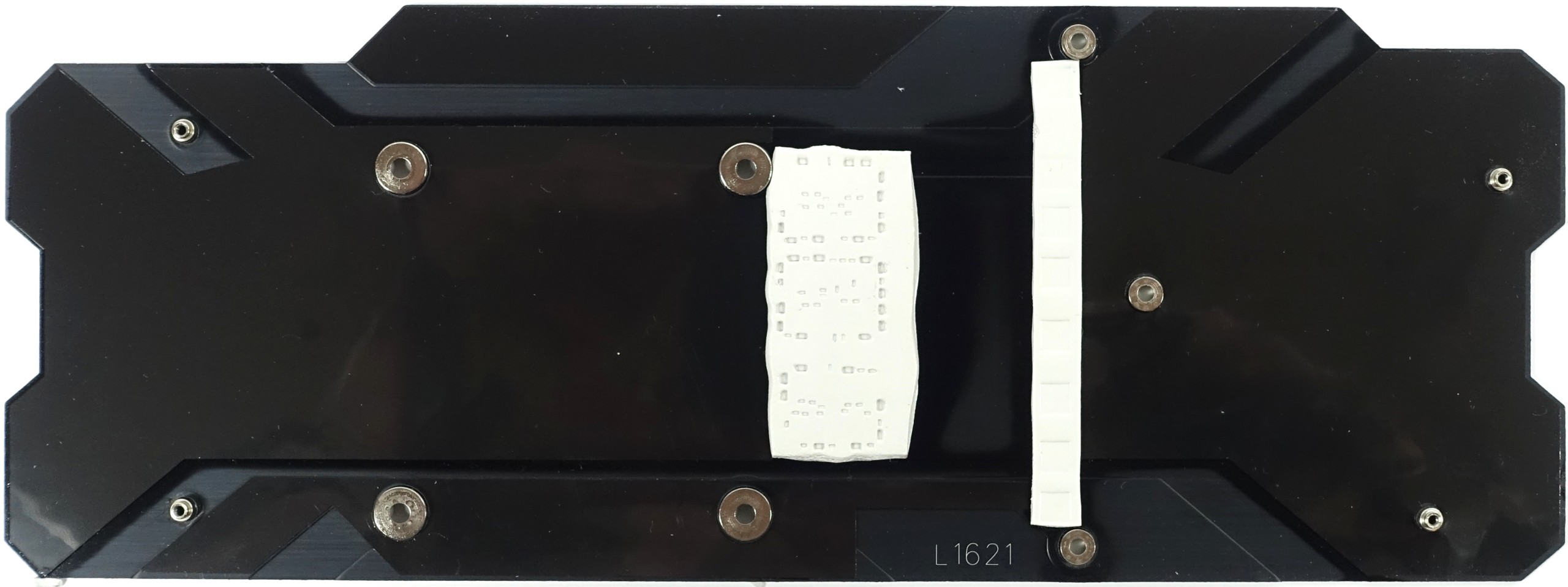

Die Rückseite der Platine ist von einer einteiligen Backplate verdeckt, die über keinerlei Lüftungsöffnungen verfügt, jedoch über Thermaltape mit den heißen Hot-Spots verbunden ist, worauf wir gleich noch einmal zurückkommen. Man muss durch diese Backplate zudem weitere fünf Millimeter Tiefe auf der Rückseite einplanen, was für Multi-GPU-Systeme wichtig sein könnte.

Allerdings ist auch der Betrieb ohne Backplate bedenkenlös möglich, jedoch macht die Demontage zunächste das Abnehmen des kompletten Kühlers notwendig (möglicher Garantieverlust).

Die Oberseite der Karte ist vom mittig platzierten, farbig leuchtenden Gigabyte-Schriftzug und dem LED-Indikator für den Silent-Betrieb geprägt, der 8-polige PCIe-Spannungsversorgunganschluss sitzt um 180° gedreht am Ende der Karte. Das Design ist sicher Geschmackssache, aber wirklich auffällig ist es nicht.

Das Ende der Karte ist komplett geschlossen, da die Lamellen eh vertikal ausgerichtet sind und somit kein Luftstrom in Richtung Kartenende bzw. Slot-Blende geht.

|

|

Die Slot-Blende bietet insgesamt fünf Ausgänge, von denen maximal vier gemeinsam betrieben werden können (Multi-Monitor-Setup). Neben dem Dual-Link-DVI-D (kein analoges Signal durchgeschleift!) finden sich auf der Rückseite noch ein HDMI-2.0-Ausgang sowie drei DisplayPort-1.4-Anschlüsse. Der Rest der Slot-Blende ist mit einigen Öffnungen für den Luftauslass versehen, die jedoch keine echte Funktion erfüllen.

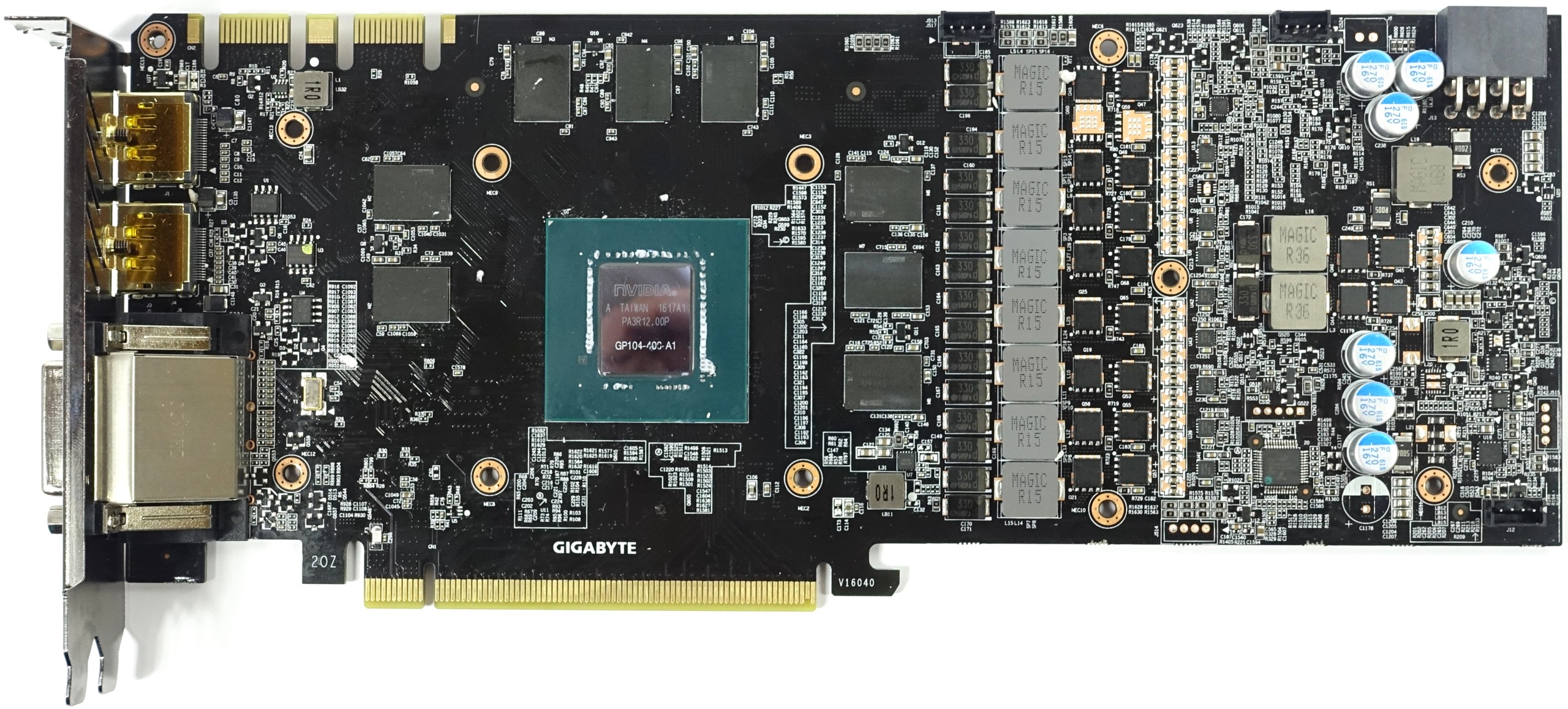

Platine und Bestückung

Ein Blick auf die Platine zeigt uns, dass die Xtreme Gaming eindeutig auf ein anderes Platinen-Layout setzen muss als die hier vorgestellte G1 Gaming – denn hier ist nur Platz für einen einzigen 8-Pin PCIe-Spannungsversorgungsanschluss.

Beim Speicher kommen GDDR5X-Module von Micron zum Einsatz, die gleich zusammen mit der GPU von Nvidia an die Board-Partner verkauft werden. Ingesamt acht dieser mit 1251 MHz (Basis) getakteten Speicherchips vom Typ MT58K256M32JA-100 sind an einem 256 Bit breiten Speicher-Interface angebunden, was eine theoretische Bandbreite von 320 GByte/s ergibt. Dabei setzt man auf ein 170-Pin-Package (statt 190 Pins bei DDR5).

Das 8+2-Phasen-System setzt wie Nvidias Referenzkarten auf einen kaum dokumentierten µP9511P als PWM-Controller. Da der PWM-Controller die MOSFETs der einzelnen Spannungswandler-Phasen nicht direkt ansprechen kann, setzt auch Gigabyte auf passende, separate PWM-Treiber (gate driver) für die Ansteuerung der insgesamt drei Single-Channel-MOSFETs pro Phase für den DC/DC-Spannungswandlerbereich. Diese dann doch unerwartet aufwändige Lösung hat uns positiv überrascht.

Dass man nicht auf kostengünstigere Dual-Channel-MOSFETs gesetzt hat und damit deutlich Platz verschenkt, könnte aber eine bessere Effizienz bezwecken, die Qualitätskontrolle vereinfachen und letztendlich auch zu einer besseren Verteilung der Hot Spots führen – zumal sich die dritte MOSFET-Reihe auf der Platinenrückseite befindet und über die Backplate aktiv mitgekühlt wird. Diese Lösung ist im aktuellen Testfeld bisher einzigartig.

Unterhalb der GPU sind ebenfalls zwei Kondensatoren aufgelötet, die Spannungsspitzen abfangen und glätten sollen. Das Platinen-Layout wirkt ziemlich vollgefrachtet, ist jedoch klar strukturiert und mit Sicherheit auch so gewollt.

Taktraten, Spannungen und Leistungsaufnahme

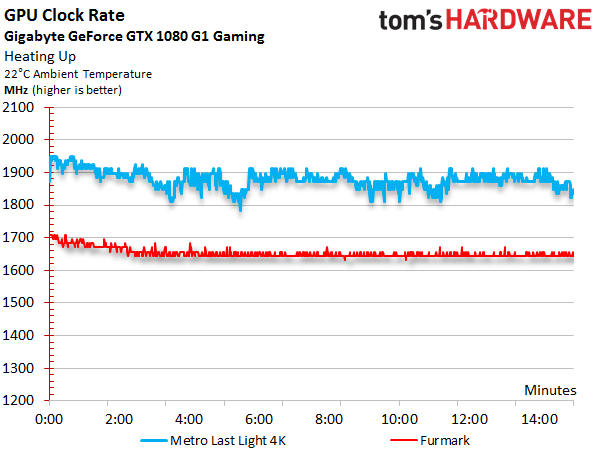

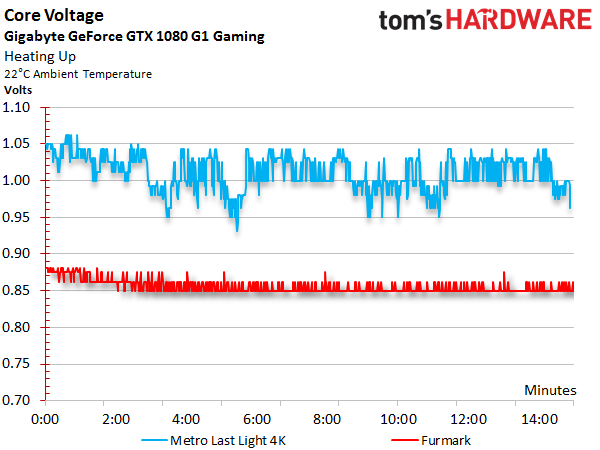

Bevor wir zur Leistungsaufnahme kommen, betrachten wir noch die Verläufe von Boost-Takt und anliegender GPU-Kernspannung, die sich nämlich sehr auffällig ähneln und die wir bewusst untereinander gestellt haben. Wir sehen auch sehr schön den Zusammenhang von Taktfrequenz und Spannung, wobei die Kurven bei steigender Erwärmung der GPU nicht ganz so stark absinken wie noch bei den beiden Founders-Editions-Modellen.

Während der Boost-Takt nach Erwärmung und unter Last stellenweise bis auf 1873 MHz (und bei vollen Lasten sogar noch weiter) fällt, sieht es auch bei den Spannungswerten ähnlich aus. Werden anfangs noch bis zu 1,062 Volt wie bei der Founders Edition erreicht, fällt diese Spannung dann später stellenweise bis auf 0,962 Volt und knapp darunter ab, wobei sie immer noch über der der Founders Edition liegt.

Aus diesen Spannungsverläufen und den fließenden Strömen ergibt sich dann auch die Leistungsaufnahme, die wir mit unserem exakten Equipment sehr gut an allen Anschlüssen messen können.

Da die Hersteller auf Grund von Nvidias Restriktionen auf die unterste mogliche Taktrate verzichten, um durch diesen Kunstgriff quasi einen Boost-Step mehr zu erhalten, steigt die Leistungsaufnahme im Idle unverhältnismäßig stark an – allerdings hat Gigabyte dieses Verhalten noch vergleichsweise gut im Griff. Der niedrigste GPU-Takt liegt jedenfalls immer noch bei stolzen 240 MHz.

Die Folgen davon zeigt die Tabelle:

| Leistungsaufnahme | |

|---|---|

| Idle | 13 Watt |

| Idle Multi-Montor | 15 Watt |

| Blu-ray | 14 Watt |

| Browser-Games | 115 bis 132 Watt |

| Gaming (Metro Last Light 4K) | 202 Watt |

| Torture (Furmark) | 203 Watt |

Natürlich wollen wir euch auch die gewohnten Detailgrafiken der Leistungsaufnahme im Idle, beim 4K-Gaming und beim Stresstest nicht vorenthalten, die sowohl die Lastverteilung auf den einzelnen Spannungs- und Versorgungsschienen abbilden, als auch einen guten Überblick über die anfallenenden Lastschwankungen und Leistungsspitzen geben können:

Kühlsystem und Temperaturen

Im direkten Zusammenhang zur aufgenommenen Leistung steht natürlich die erzeugte Abwärme, für deren optimale Abführung die Kühllösung verantwortlich ist.

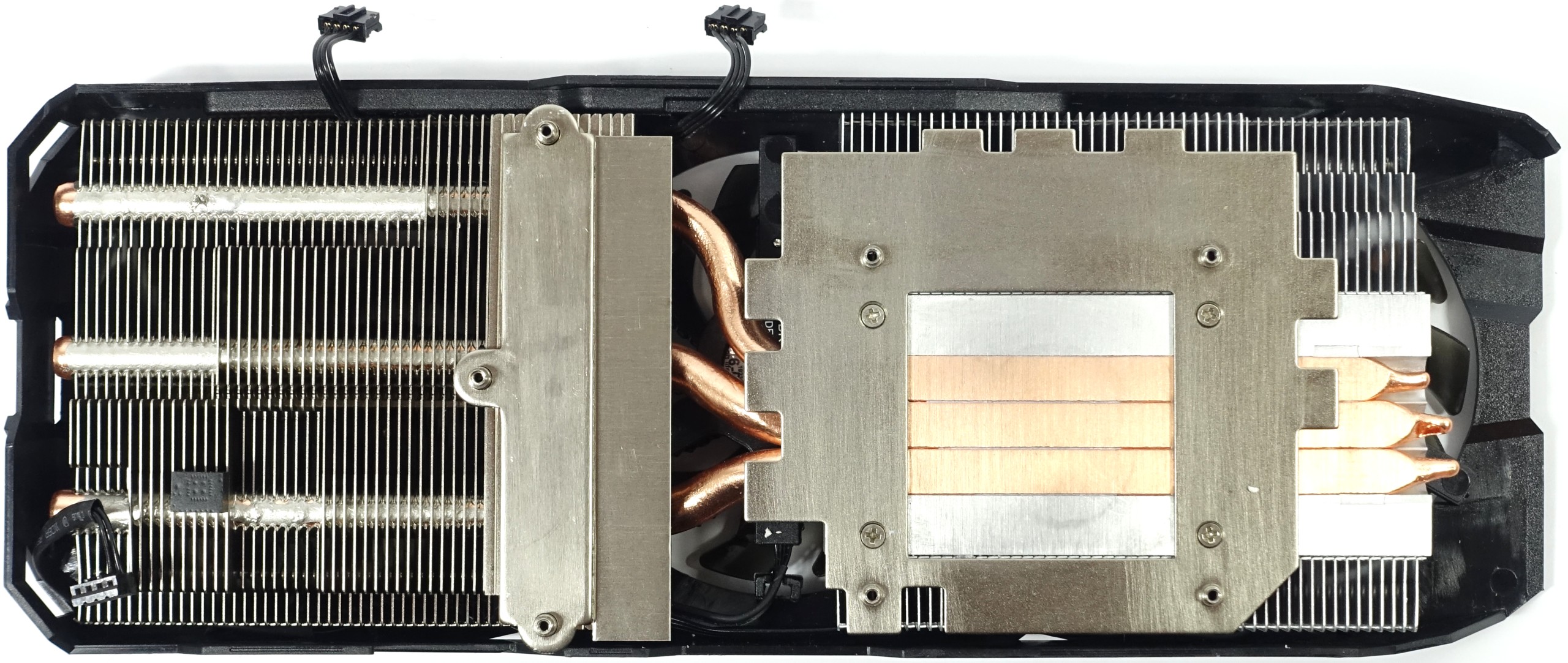

Gigabyte setzt auf sein übliches Windforce-Design, dem man das Alter durchaus ansieht bzw. anhört. Jedoch musste der eigentliche Kupferkühlkörper einer simplen (und preiswerteren) DHT-Lösung weichen (Direct Heat Touch), bei dem die drei angeschliffenen Heatpipes aus gesintertem Kompositmaterial direkt auf der GPU aufliegen.

Der Rest der Kühlerplatte dient der Kühlung der Speicherbausteine und löblicherweise auch der Spannungswandler. Für den Kontakt dienen passende Wärmeleitpads.

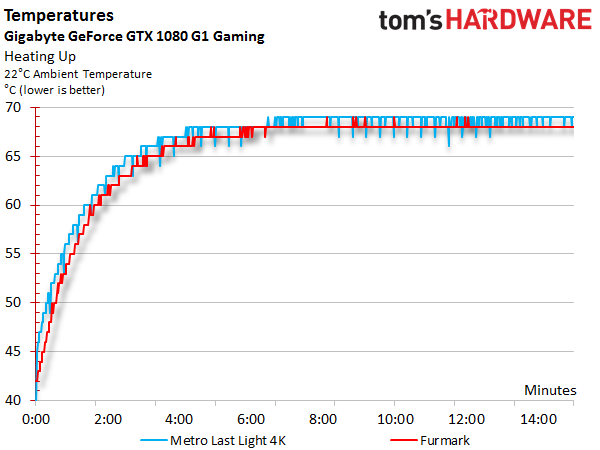

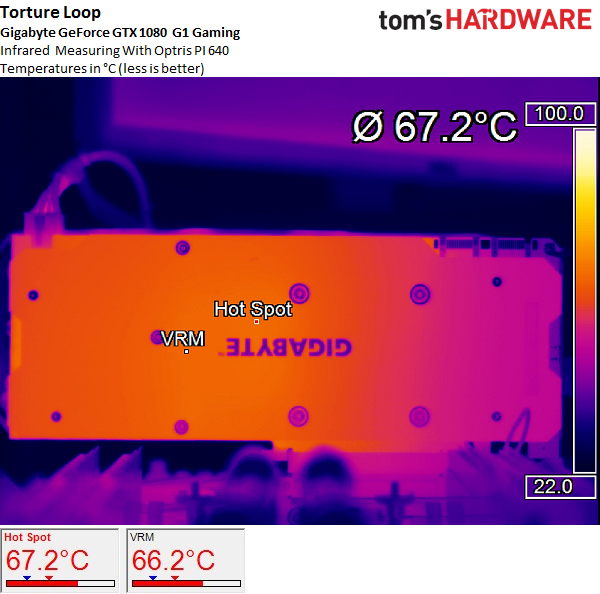

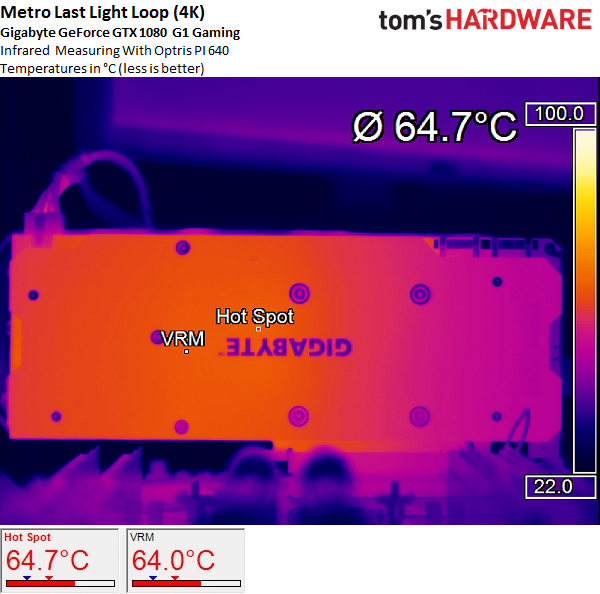

Die etwas bessere Performance des Kühlers im Vergleich zur Founders Edition spiegelt sich auch im Temperaturverlauf wieder, denn die Grenze von 70°C wird nicht oder nur knapp (72°C im geschlossenen Gehäuse) überschritten.

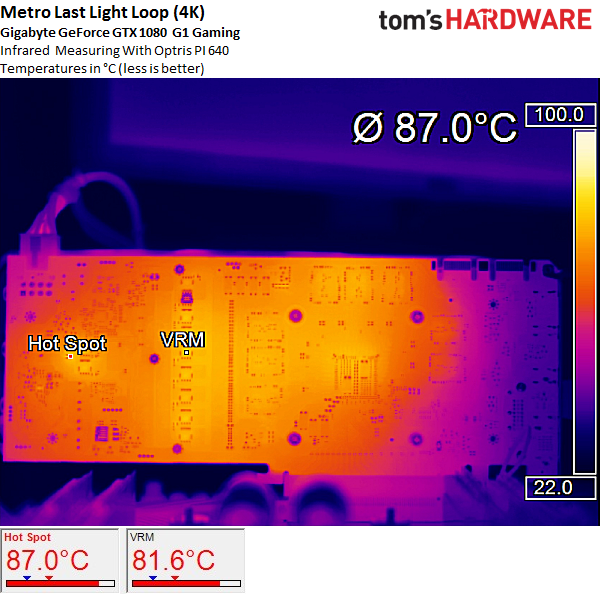

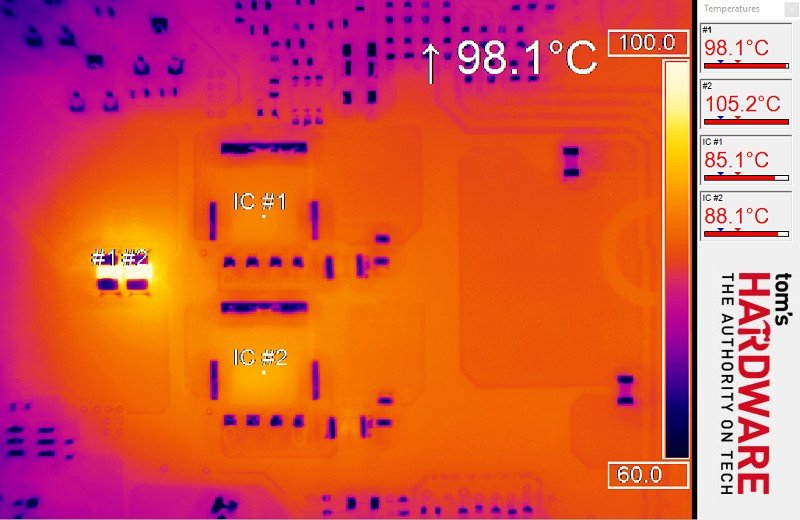

Soweit, so kühl. Betrachtet man aber die Infrarot-Bilder der Platine, ergeben sich andere Problemzonen und thermale Speckröllchen. Die Spannungswandler bleiben mit knapp 82°C erfreulich kühl, jedoch glühen zwei kleinere SMD-Widerstände mit 87°C bereits recht ordentlich.

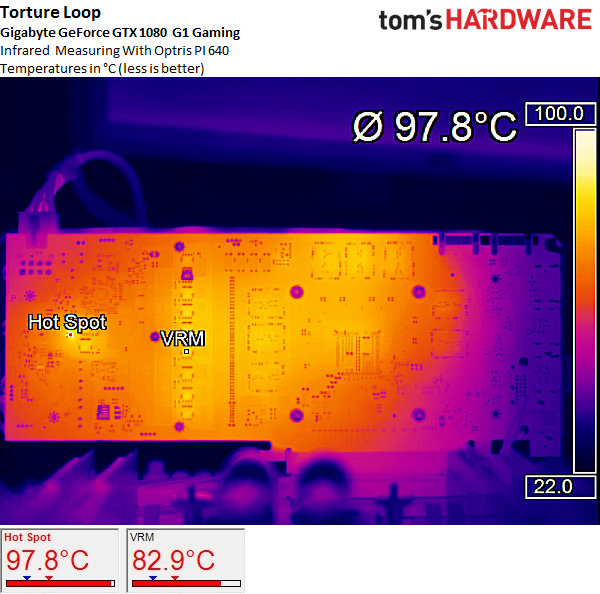

Beim Torture Loop werden die beiden Widerstände (R990 und R991) fast 100°C warm, während die Spannungswandler nur unwesentlich zulegen.

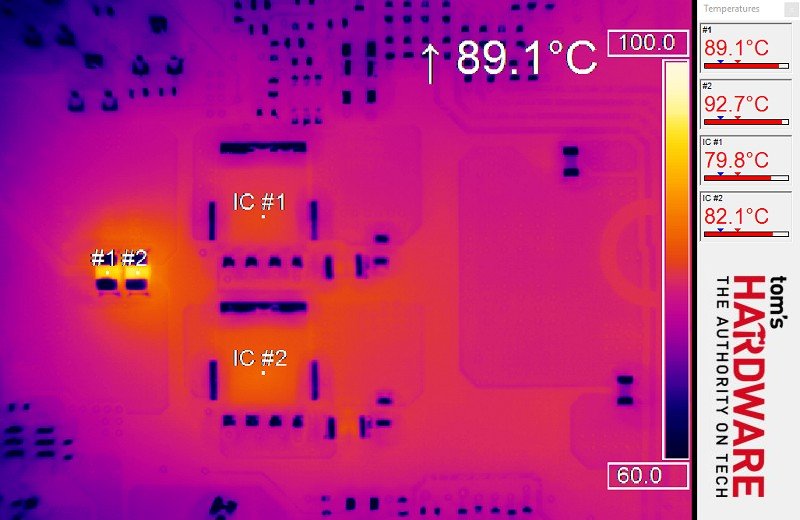

Um das mit den zwei Shunts noch einmal genauer zu testen, nutzen wir einen Abstand von nur sieben Zentimetern und ein anderes Objektiv für die IR-Kamera, denn die beiden zu messenden Flächen sind ja nur etwa einen Quadratmillimeter groß. Ein Blick in die Specs hat nach Rücksprache mit Gigabyte ergeben, dass hier definitiv erst einmal nichts passieren wird.

Auch unter Furmark wären die Temperaturen laut Specs noch gerade so im Rahmen. Jedoch kommt noch der Umstand hinzu, dass sich exakt darüber auf der Oberseite der Platine der PWM-Controller befindet, der ja auch einiges an punktueller Abwärme produziert – damit hätten wir dann zwei Hotspots an einer Stelle.

Erste Tests haben mittlerweile ergeben, dass man hier mit einem weiteren Wärmleitpad locker Abhilfe schaffen kann, so dass auch dieser Vorschlag – so wie auch der mit den anderen Pads – mittlerweile den Einzug in Gigabytes Massenproduktion gefunden hat.

Mit montierter Backplate, bei der zwischen den Bereichen der RAM-Module und der VRM ebenfalls Wärmleitpads zum Einsatz kommen, sehen die “Außentemperaturen” dann so aus:

|

|

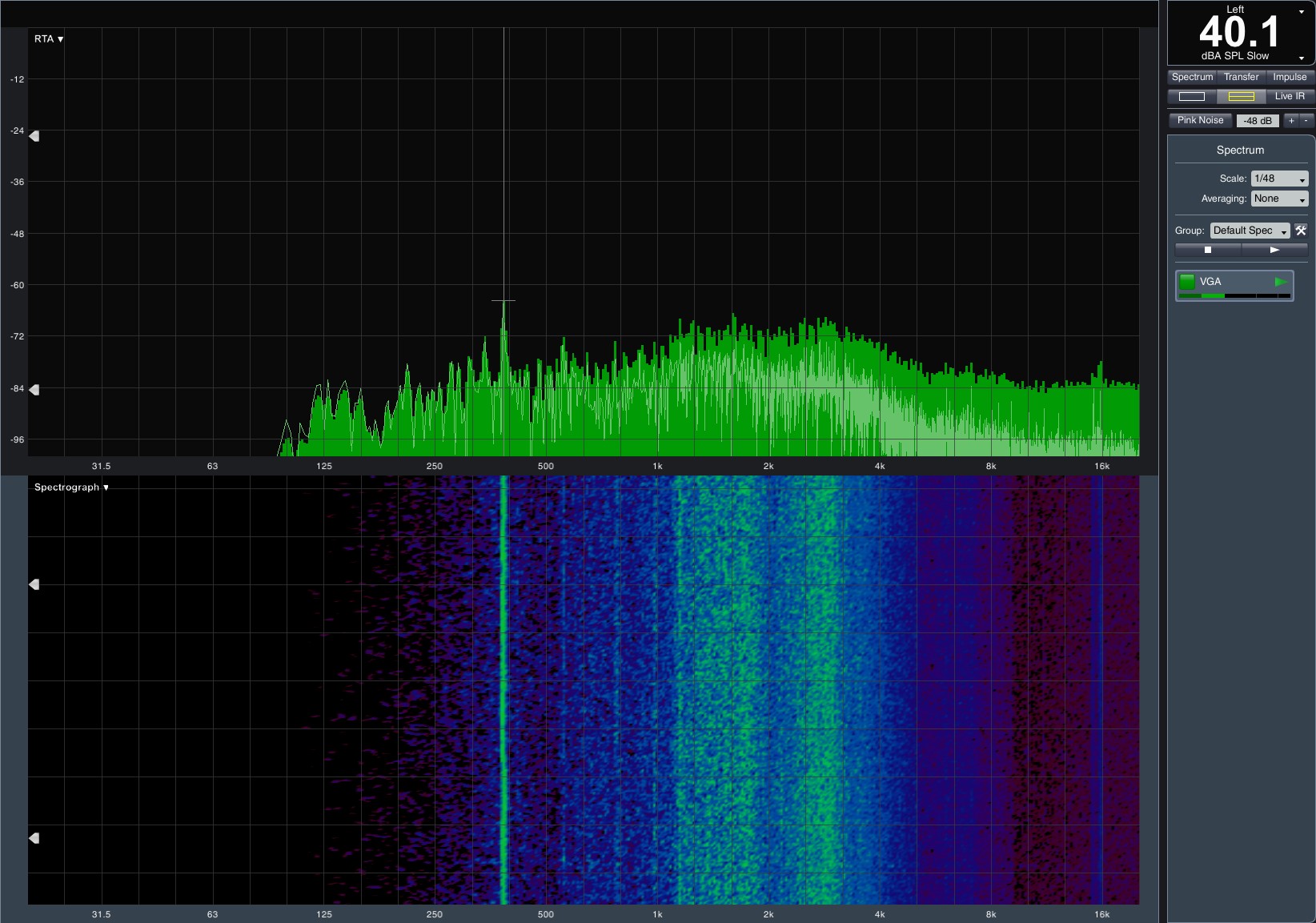

Geräuschentwicklung

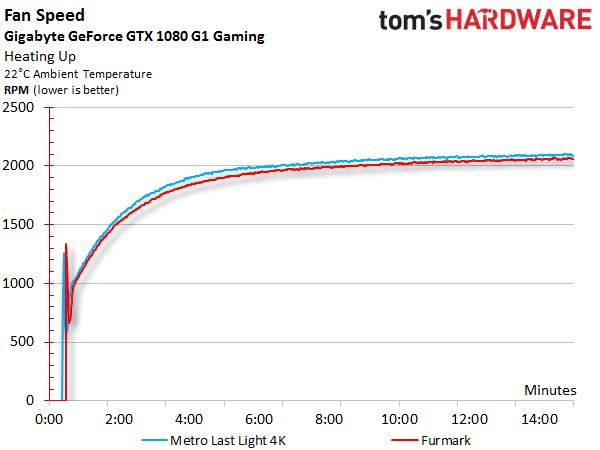

Da die Leistungsaufnahme beim Gaming und beim Stresstest durch das Power Target sehr ähnlich ausfällt, liegen auch beide Lüfterkurven ziemlich deckungsgleich aufeinander. Gut zu beobachten ist das Anlaufverhalten und die sauber implementierte Hysterese, die ein mehrfaches An/Aus beim Erreichen der Einschalttemperatur sicher verhindert.

Außerdem ist die Anlaufdrehzahl so gewählt, dass die Lüfter auch nach ihrer Alterung noch sicher anlaufen dürften. Das Gleiche gilt auch für das Abschalten der Lüfter nach Abkühlung der Karte.

Die Geräuschentwicklung im Idle ist auf Grund des semi-passiven Modus nicht messbar, so dass wir auf diese Messung gleich ganz verzichtet haben.

Bei lang anhaltender Volllast erreicht man locker die 40 dB(A)-Marke, beim Torture-Test geht es noch etwas höher. Das ist für eine solche Karte eigentlich schon etwas zu viel, wobei man sich durch eine manuelle Anpassung der Lüfterkurve sowie das Hochsetzen des Temperatur-Targets auf 75°C behelfen könnte. Allerdings leidet dann der erreichbare Boost-Takt ein wenig – und man hört die Spulen ein wenig im Hintergrund zirpen.

Wenn man sieht, was andere Hersteller mit dickeren Kühlern erreichen können, wirkt die auf der G1 Gaming verbaute Kühllösung fast schon ein wenig unambitioniert und lieblos – man hätte es mit wenig Mehraufwand deutlich besser hinbekommen können. Das Ganze ist nicht schlecht, aber eben auch nicht übermäßig gut.

Technische Daten und Zwischenfazit

Betrachten wir nun noch einmal zusammenfassend die technischen Daten und individuellen Details der Grafikkarte:

- 1 - Einführung und Übersicht

- 2 - Asus GeForce GTX 1070 Strix OC

- 3 - EVGA GeForce GTX 1080 FTW

- 4 - Gigabyte GeForce GTX 1070 Mini ITX OC

- 5 - Gigabyte GeForce GTX 1070 G1 Gaming

- 6 - Gigabyte GeForce GTX 1080 G1 Gaming

- 7 - Gigabyte GeForce GTX 1080 Xtreme Gaming

- 8 - KFA²/Galax GeForce GTX 1070 EX

- 9 - KFA²/Galax GeForce GTX 1080 HoF (Hall of Fame)

- 10 - MSI GeForce GTX 1070 Gaming X 8G

- 11 - MSI GeForce GTX 1080 Gaming X 8G

- 12 - MSI GeForce GTX 1080 Sea Hawk

- 13 - Nvidia GeForce GTX 1070 Founders Edition

- 14 - Nvidia GeForce GTX 1080 Founders Edition

- 15 - Palit GeForce GTX 1070 Game Rock Premium Edition

- 16 - Palit GeForce GTX 1080 Game Rock Premium Edition

- 17 - PNY GeForce GTX 1080 XLR8

- 18 - Zotac GeForce GTX 1080 AMP! Extreme

- 19 - Vergleich der Gaming-Performance

- 20 - Vergleich vom Temperatur, Lautstärke und Leistungsaufnahme

Kommentieren