Die Gigabyte GeForce GTX 1070 G1 Gaming soll eigentlich ihrer alten Bestimmung folgen und möglichst viel Leistung für einen akzeptablen Preis zu liefern. Drei Lüfter und eine auf den ersten Blick auch martialische Aufwachung implizieren nämlich genau das.

Die Gigabyte GeForce GTX 1070 G1 Gaming soll eigentlich ihrer alten Bestimmung folgen und möglichst viel Leistung für einen akzeptablen Preis zu liefern. Drei Lüfter und eine auf den ersten Blick auch martialische Aufwachung implizieren nämlich genau das.

Doch ob es gelingt, dies am Ende auch genau so in die Realität zu transportieren, muss erst dieser Test beweisen. Merke: nicht jeder Benchmarkbalken ist dick und lang genug, um ein Konzept sicher tragen zu können. Und nur allzu oft zieht der mit dem vermeintlich Längeren dann auch schon mal den Kürzeren. Wahrheit oder Pflicht? Wir testen einfach mal beides.

Äußerer Aufbau und Anschlüsse

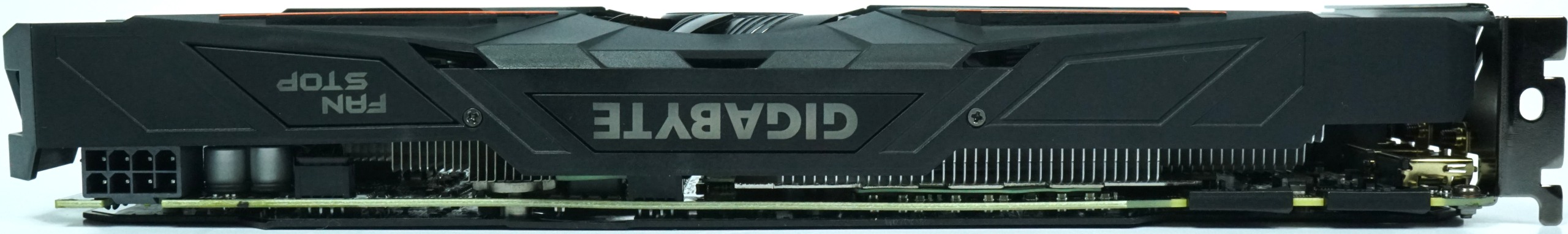

Die Kühlerabdeckung besteht aus anthrazitfarbenem, matten Kunststoff mit auffälligen Farbapplikationen in Orange. Mit genügsamen 797 Gramm ist die G1 Gaming ein wahres Fliegengewicht, was den Einbau völlig unproblematisch macht. Die Länge von 28,2 cm ist einigermaßen erträglich, die Höhe von 11,5 cm guter Durchschnitt und die Einbautiefe von 3,5 cm typisch für ein Dual-Slot-Design.

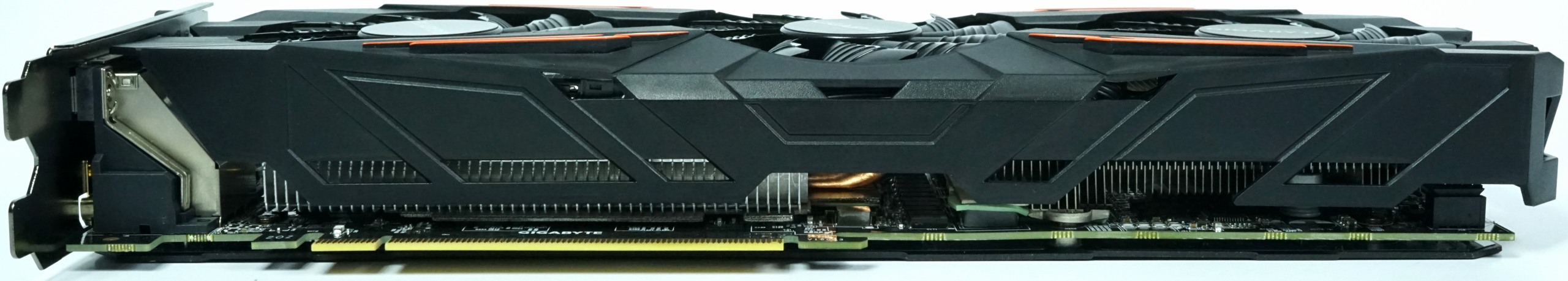

Insgesamt drei doch recht kleine 80mm-Lüfter sollen hier für den richtigen Durchzug sorgen. Das es erst einmal nicht auffällt, dass die Lüfter so klein sind, liegt an den Proportionen, bei denen die Länge über die Höhe dominiert. Das teil sieht also erst einmal wuchtiger aus, als es in Wirklichkeit ist.

|

|

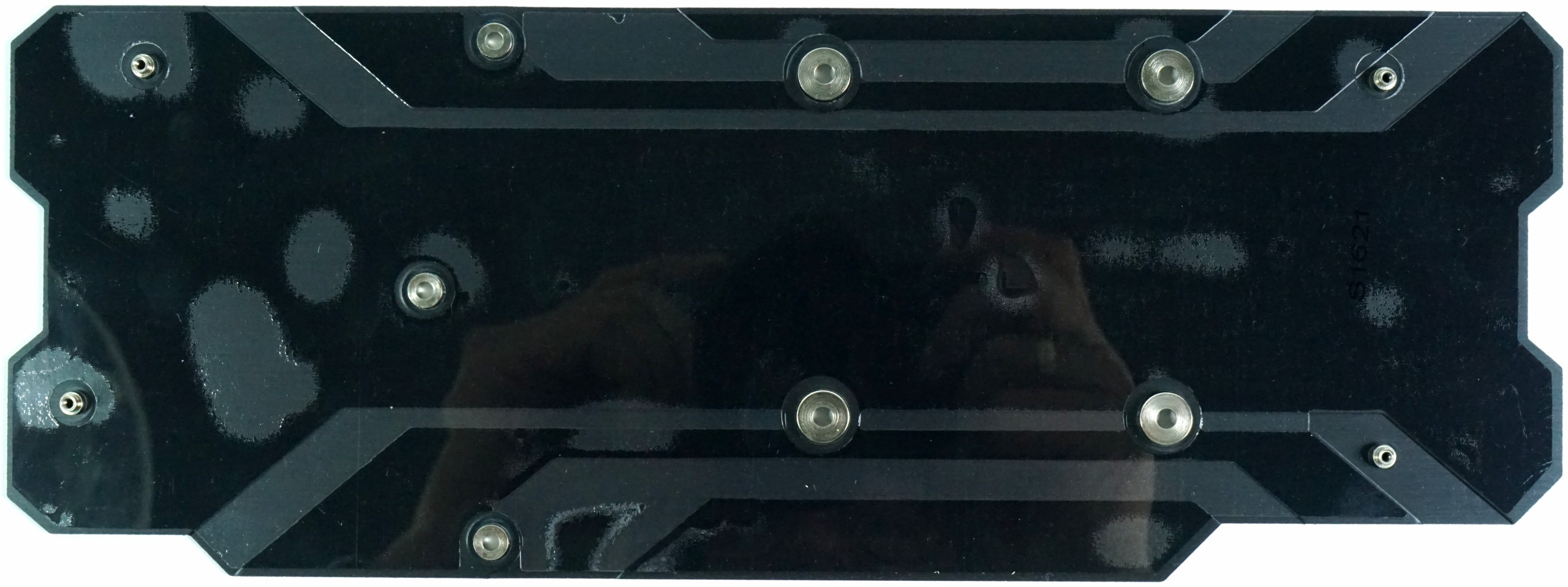

Die Rückseite der Platine ist von einer einteiligen, geschwärzten Aluminium-Backplate verdeckt, samt einem weißen, unbeleuchtetem Gigabyte-Logo, Man muss durch diese Backplate mindestens weitere fünf Millimeter Tiefe auf der Rückseite einplanen, was für Multi-GPU-Systeme wichtig sein könnte.

Die Oberseite der Karte trägt einen “Gigabyte”-Schriftzug samt RGB-LED-Hintergrundbeleuchtung, den Fan-Stop-Indikator, sowie einen 8-poligen PCIe-Spannungsversorgunganschluss am Ende der Grafikkarte.

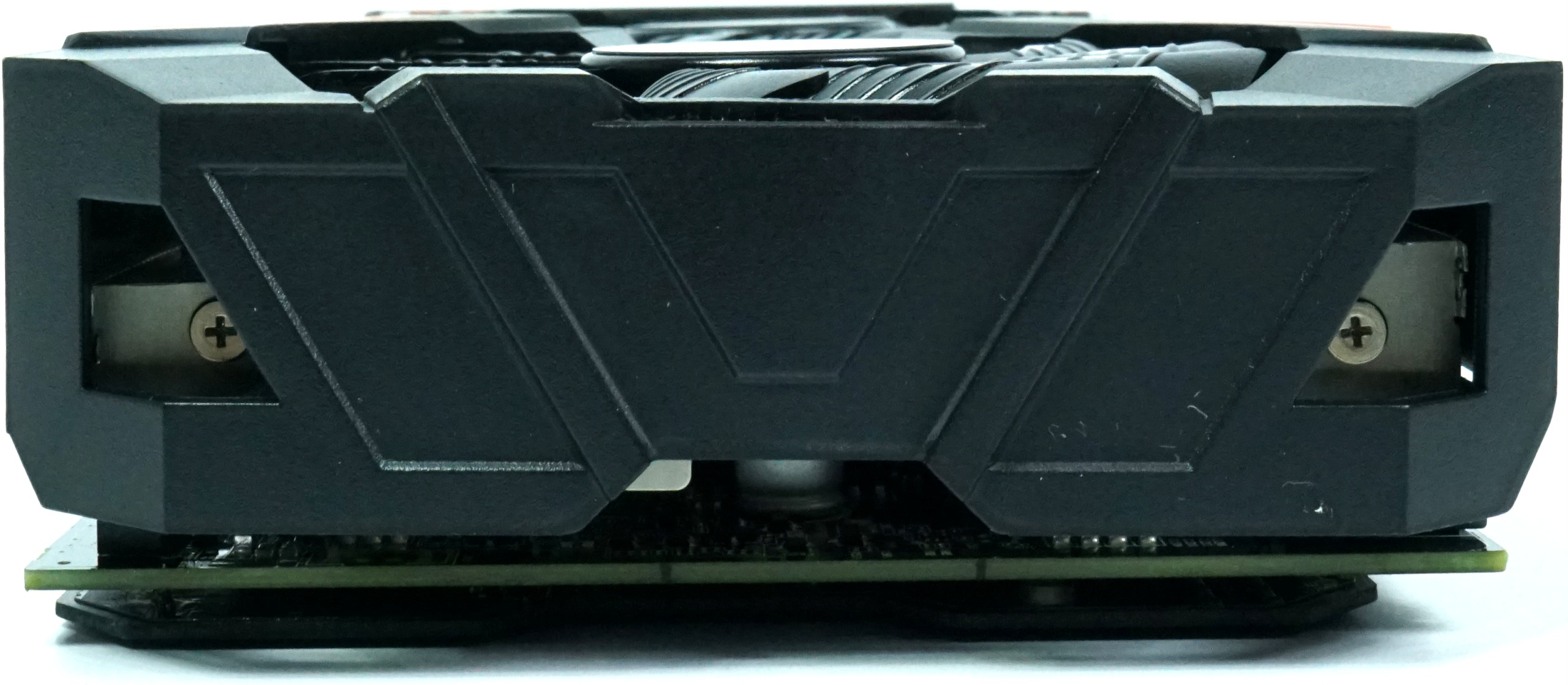

Das eben angesprochene Ende der Karte zeigt wie ihre Unterseite, dass die Lamellen vertikal ausgerichtet sind und somit auch kein Luftstrom in Richtung Kartenende bzw. Slot-Blende geht. Das ist in Bezug auf die Erwärmung von Mainboard und Luft im Gehäuseinneren eher kontraproduktiv.

|

|

Die Slot-Blende trägt insgesamt fünf Ausgänge, von denen maximal vier gemeinsam betrieben werden können (Multi-Monitor-Setup). Neben dem Dual-Link-DVI-D-Port (kein analoges Signal durchgeschleift!) finden sich auf der Rückseite noch ein HDMI-2.0-Ausgang sowie drei DisplayPort-1.4-Anschlüsse. Der Rest der Slot-Blende ist mit eingen wenigen Öffnungen für den Luftauslass versehen, die aber aufgrund der Lamellenausrichtung nur dekorative Zwecke erfüllen.

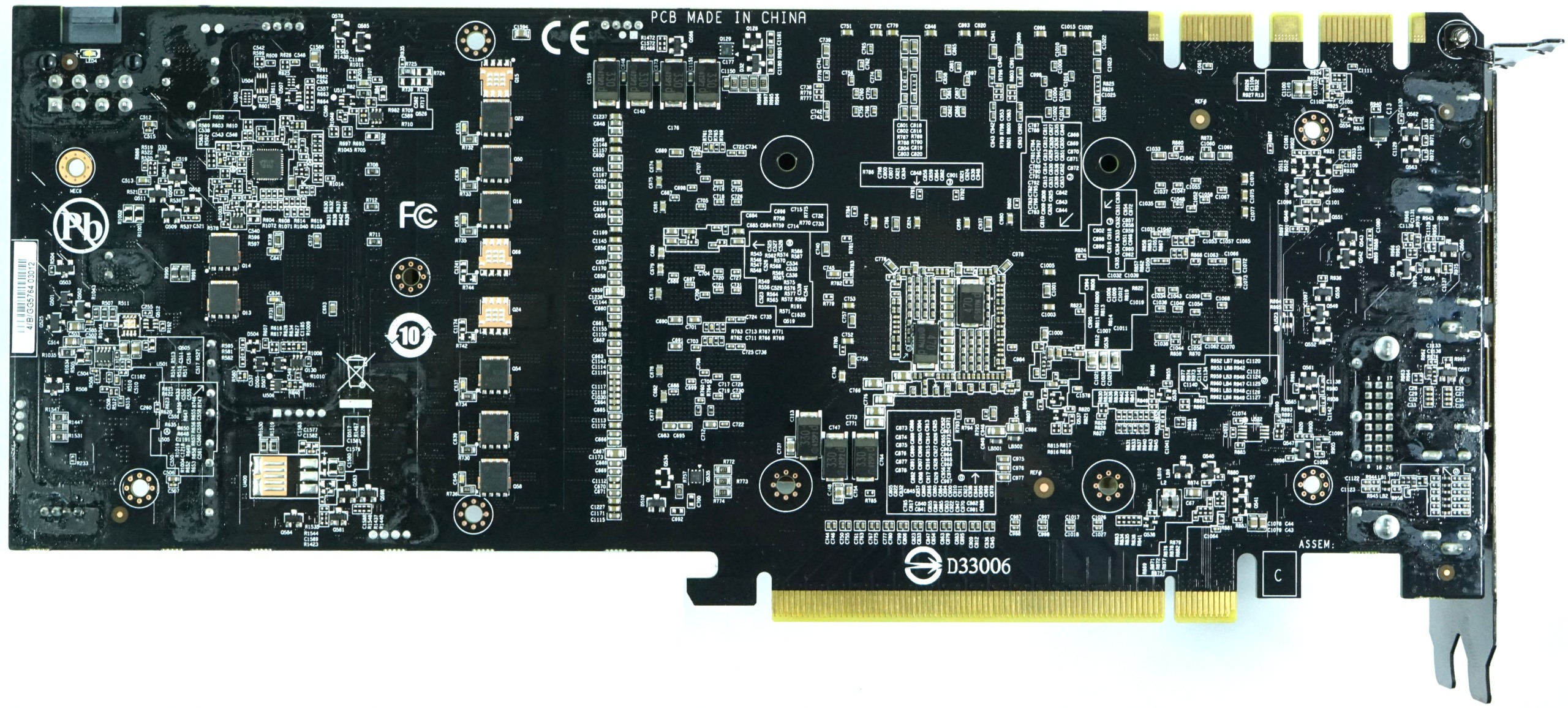

Platine und Bestückung

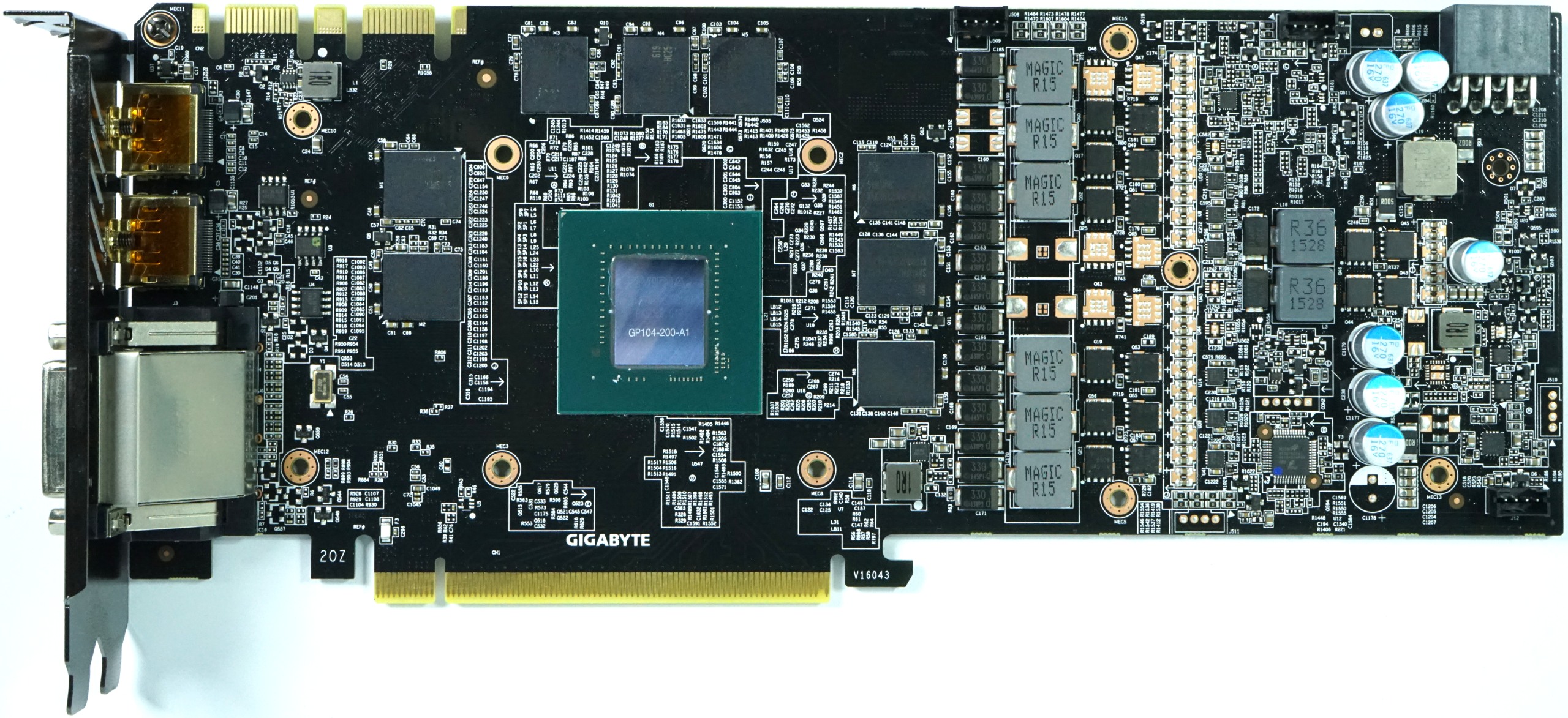

Die verwendete Platine ist ein Eigendesign mit teils sehr konservativer und teils interessanter Bestückung. Doch immer schön der Reihe nach.

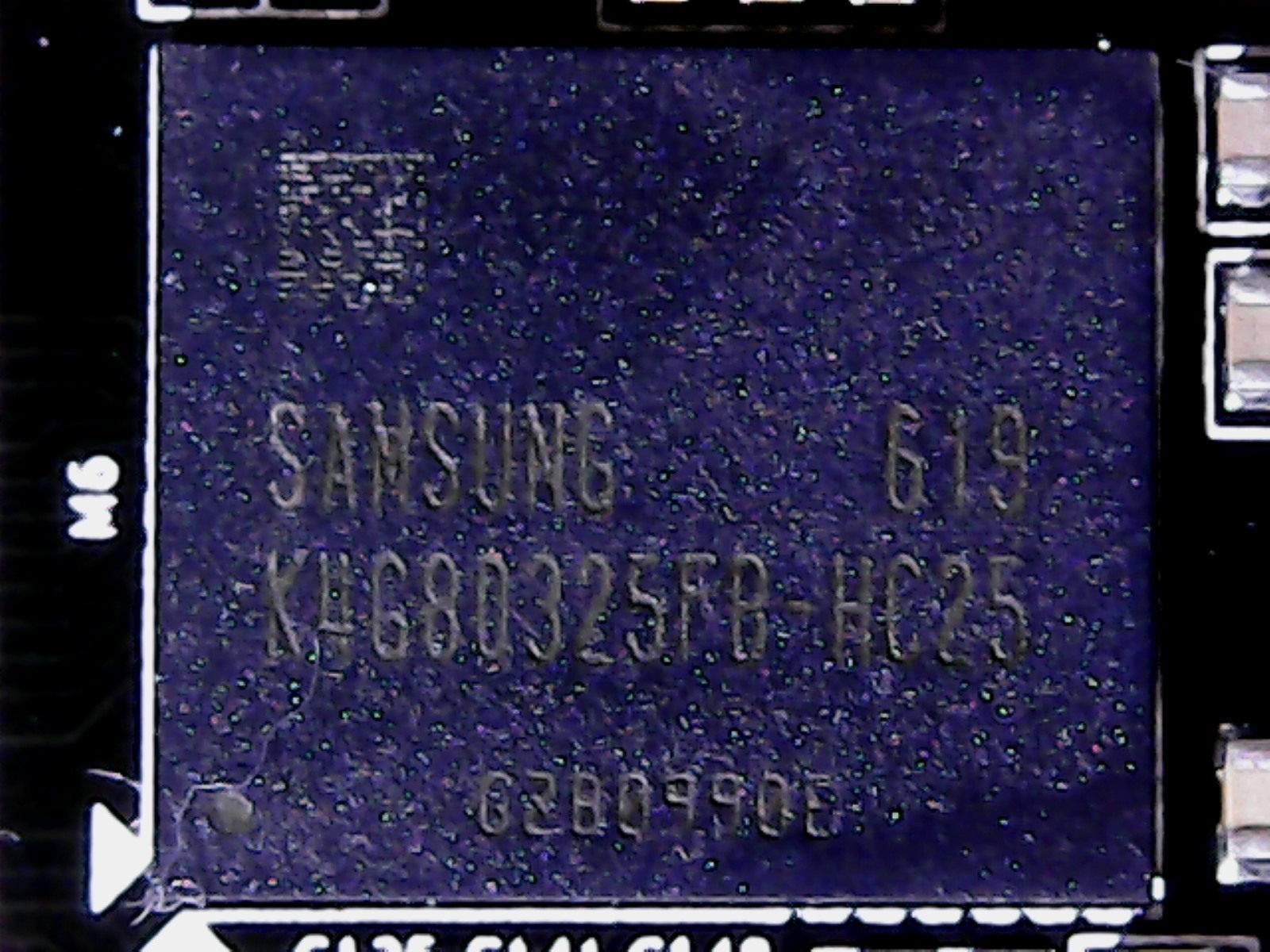

Beim Speicher kommt zuäncht erst einmal der übliche GDDR5-Speicher von Samung zum Einsatz. Die acht Module vom Typ K4G80325FB-HC25 besitzen eine Kapazität von jeweils acht Gigabit (32x 256 MBit), die je nach abgefordertem Takt mit Spannungen zwischen 1,305 und 1,597 Volt betrieben werden können.

Beim Speicher kommt zuäncht erst einmal der übliche GDDR5-Speicher von Samung zum Einsatz. Die acht Module vom Typ K4G80325FB-HC25 besitzen eine Kapazität von jeweils acht Gigabit (32x 256 MBit), die je nach abgefordertem Takt mit Spannungen zwischen 1,305 und 1,597 Volt betrieben werden können.

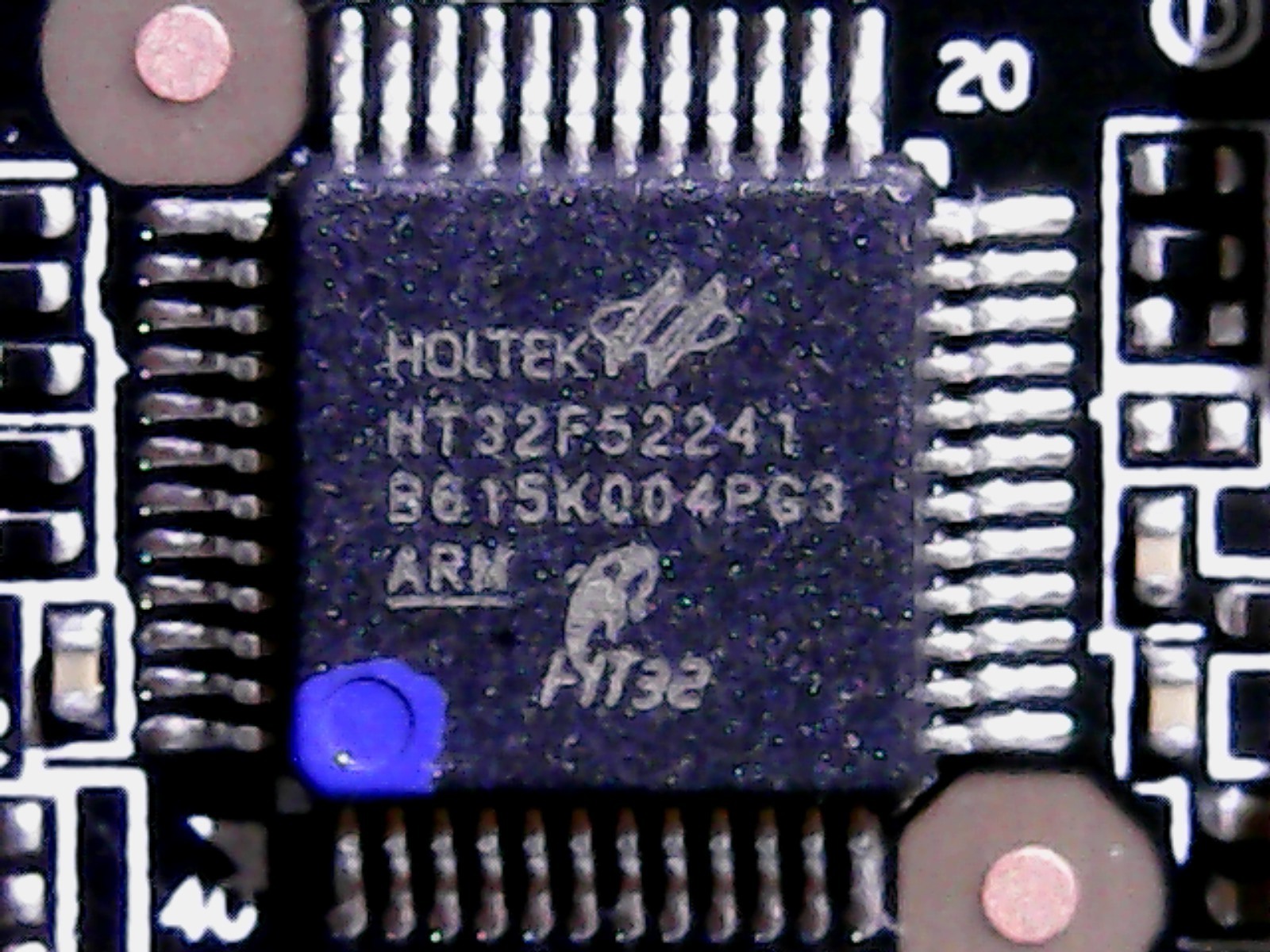

Was uns bei der Platine auf den ersten Blick ins Auge sprang, war der 32-Bit ARM Cortex M0+ Prozessor von Holtek, den Gigabyte allein nur für die Steuerung der RGB-Effekte nutzt.

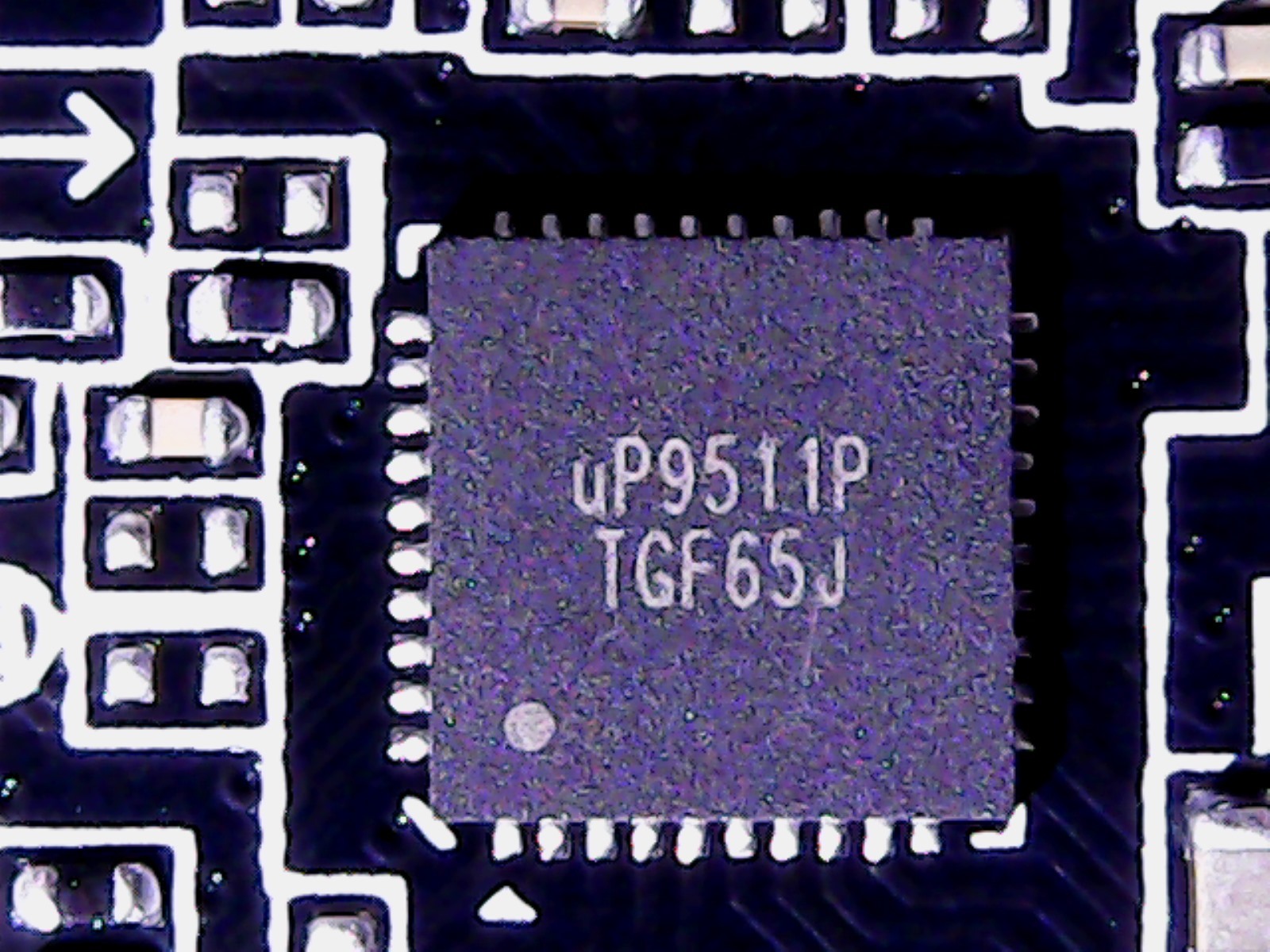

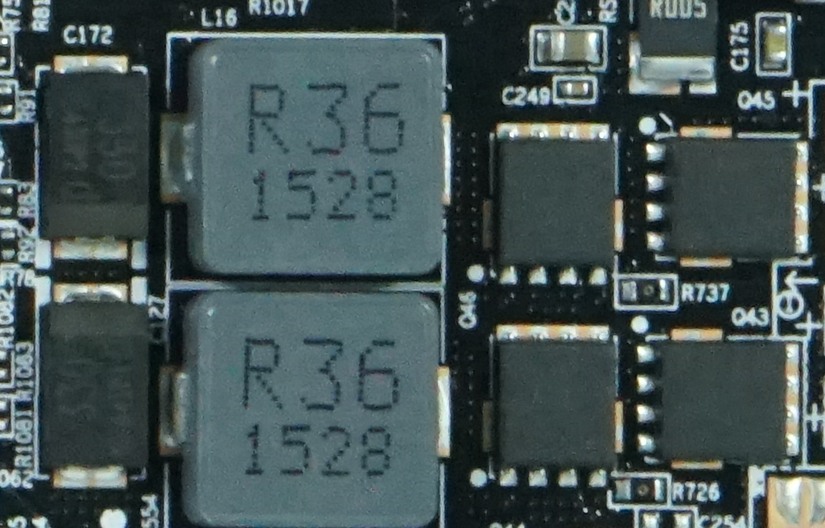

Die Spannungsversorgung ist ebenfalls nicht ganz alltäglich umgesetzt worden. Der Hersteller setzt auf ein eigentlich bereits überdimensioniertes 6+2-Phasen-Design, wobei die sechs Phasen für die GPU von einem der üblichen uP9511 von uPI Semiconductor Corp angesteuert werden.

|

|

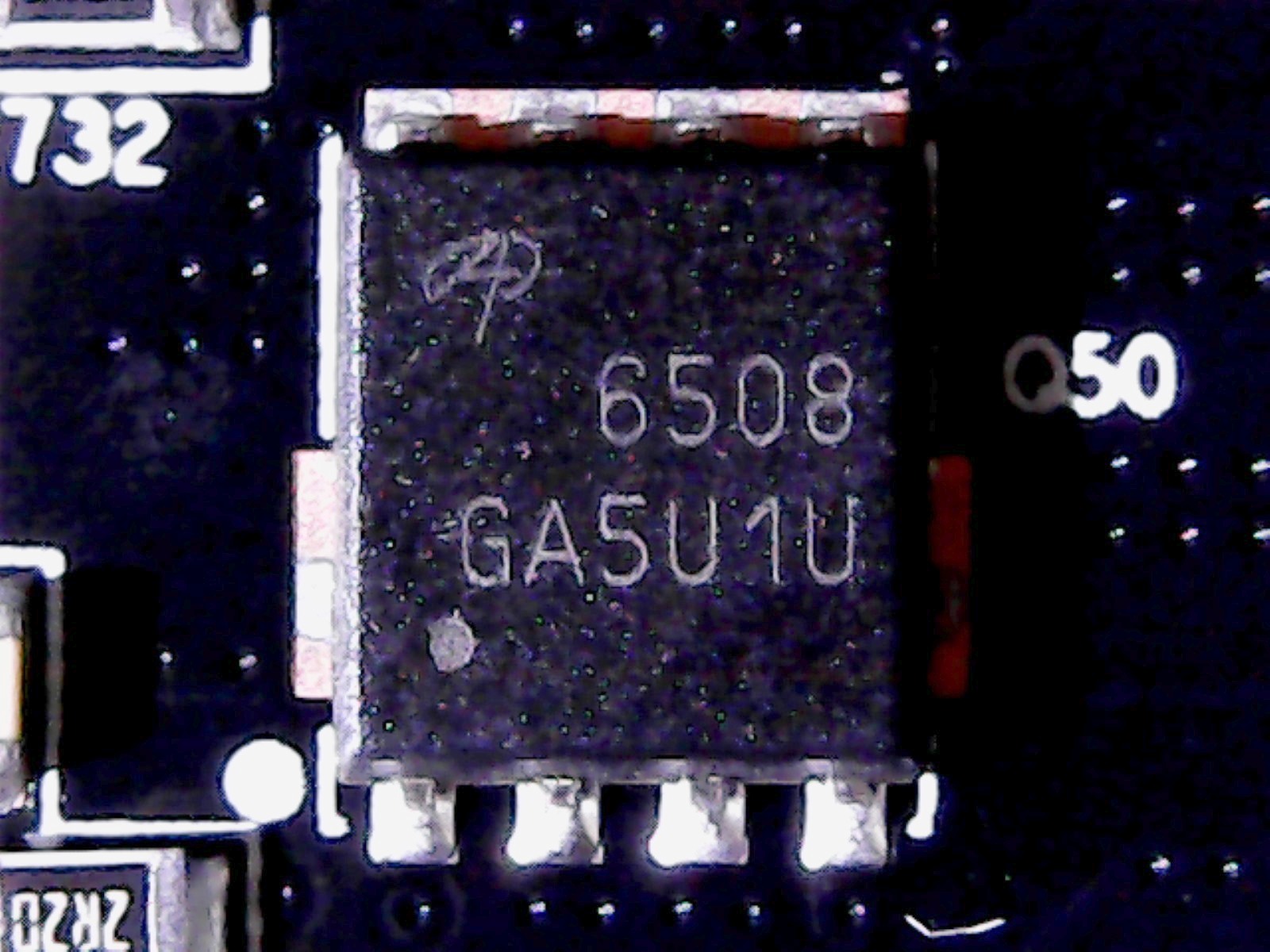

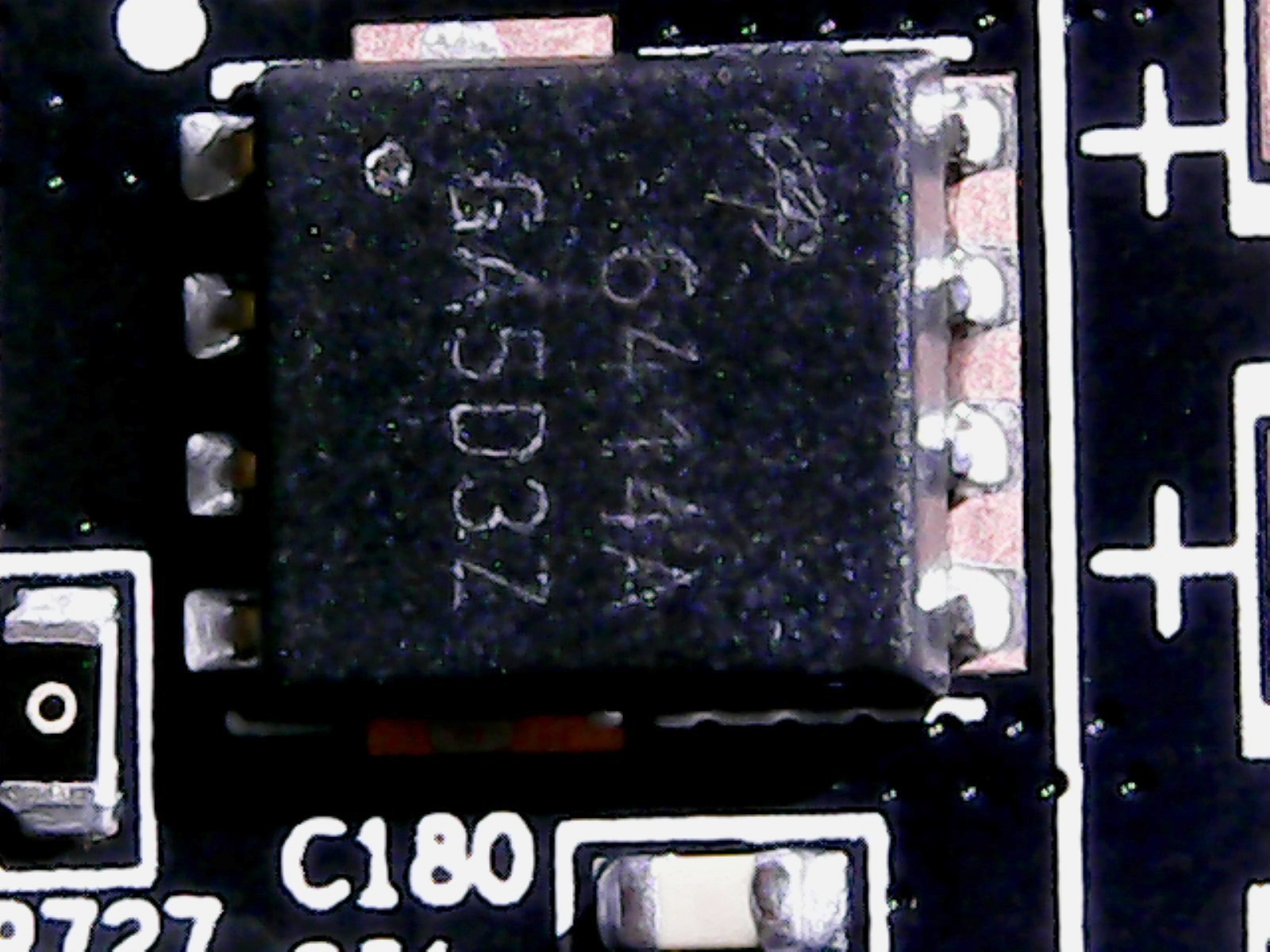

Die Spannungswandler für die GPU sind pro Phase mit jeweils einem AON6508 Trench Power AlphaMOS auf der Low- und einem AON 6414 (beide von Alpha & Omega Semiconductor) umgesetzt worden. Interessant ist bei beiden MOSFETs der recht geringe Innenwiderstand über die gesamt Leistungskurve, sowie die niedrigen Ansteuerungswerte für die Gates, so dass man hier wohl versucht hat, die Spannungswandlerverluste etwas zu minimieren.

|

|

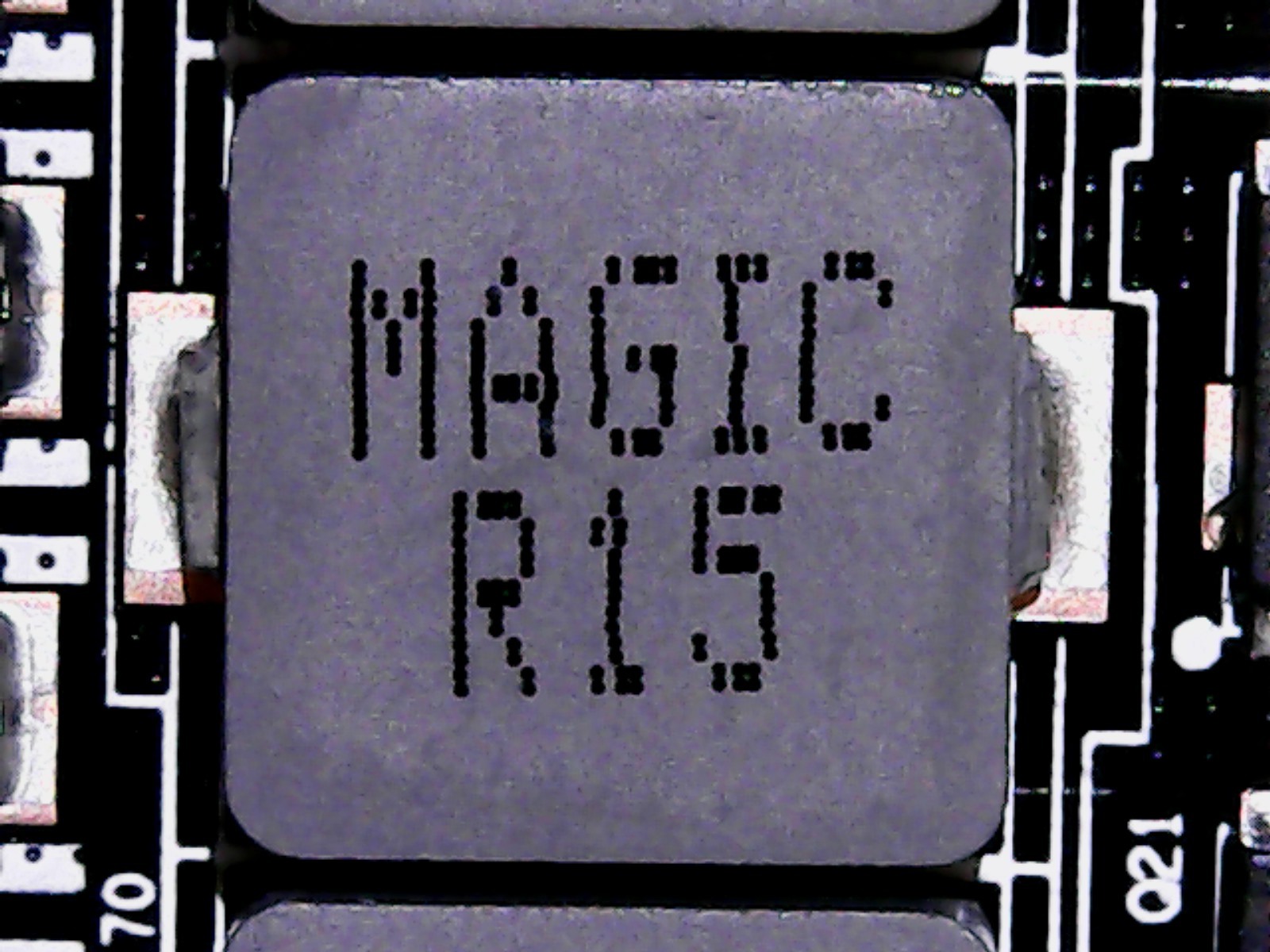

Bei den verwendeten Spulen setzt man erneut auf Foxconns Magic Coils, die komplett gekapselt sind und sich auch maschinell gut bestücken lassen.

|

|

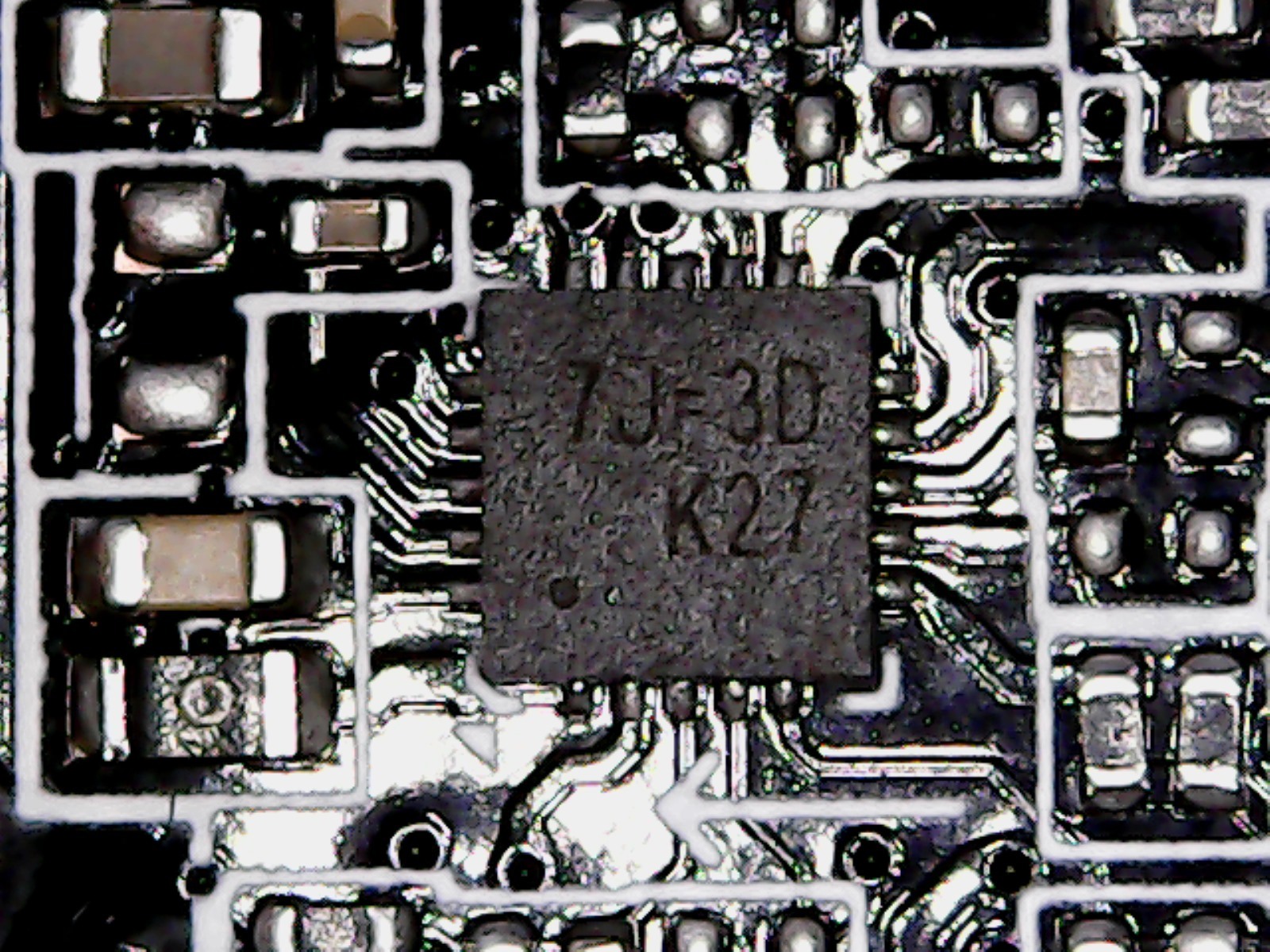

Die beiden Phasen für den Speicher werden von einem ungelabelten PWM-Controller bereitgestellt, der in etwa einem uP1666 entsprechen sollte, der die Bootstrap-Schottky-Dioden und die Gate-Driver bereits integriert hat. Die MOSFET-Bestückung von Low- und High-Side entspricht der Auswahl für die GPU-Phasen, nur die Spulen sind etwas kleiner.

|

|

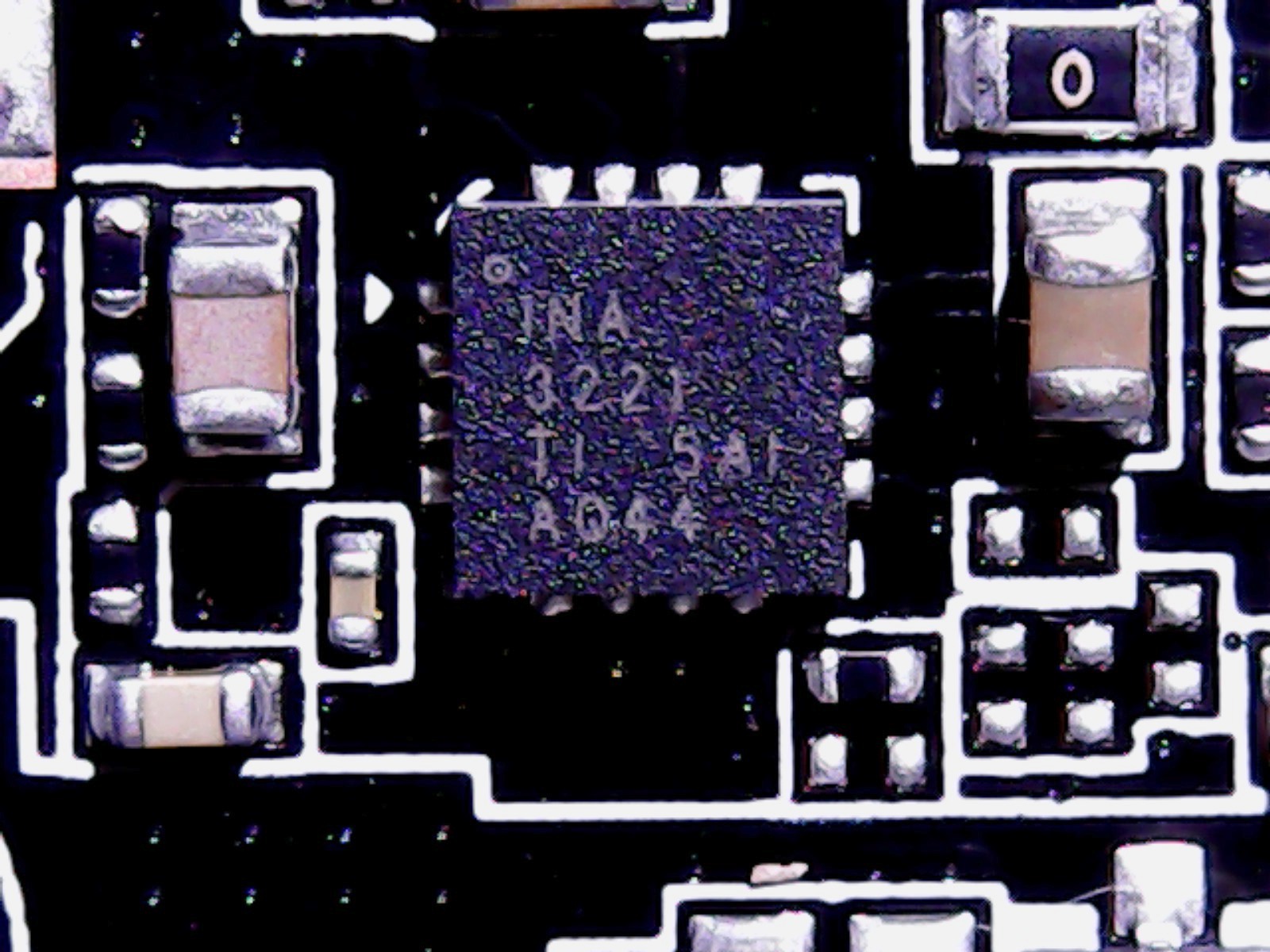

Mit dem üblichen INA3221 realisiert Gigabyte u.a. das Current-Monitoring für die Überwachung der fließenden Ströme. Unterhalb der GPU sind dann noch die üblichen beiden Kondensatoren aufgelötet, die Spannungsspitzen abfangen und glätten sollen.

Taktraten, Spannungen und Leistungsaufnahme

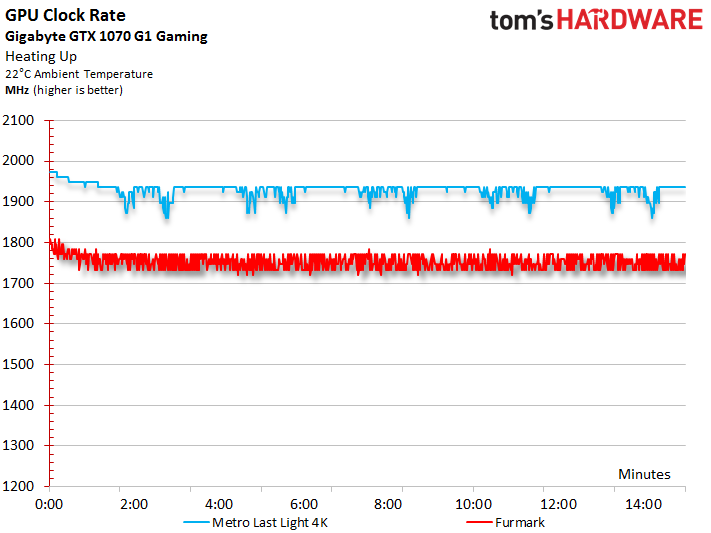

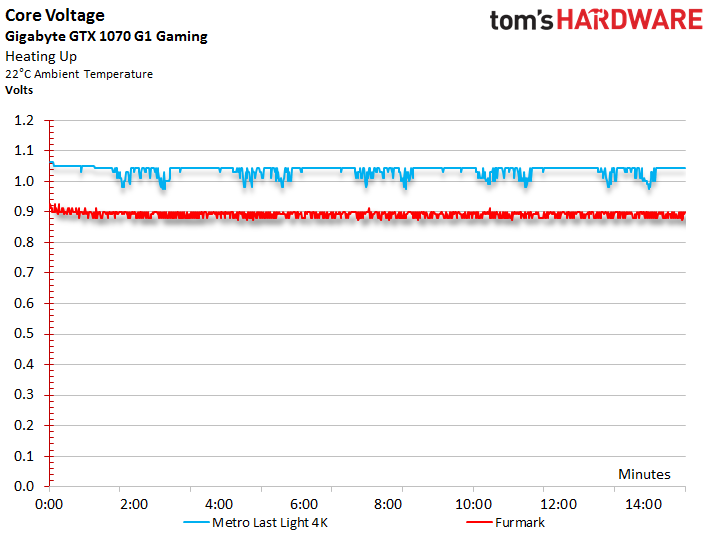

Bevor wir zur Leistungsaufnahme kommen, betrachten wir noch die Verläufe von Boost-Takt und anliegender GPU-Kernspannung, die wir wegen ihrer großen Ähnlichkeit bewusst untereinander gestellt haben. Man sieht hier sehr schön den Zusammenhang von Taktfrequenz und Spannung, wobei das von Gigabyte verwendete Power Target von ca. 185 Watt für einen leicht nervösen Boost-Takt sorgt, dessen kurzzeitige Einbrüche auf das temporäre Erreichen des Power-Limits schließen lassen.

Während sich der Boost-Takt nach Erwärmung und unter wechselnden Lasten (Gaming) von anfänglich 1974 MHz bei ca. 1936 MHz im Mittelwert MHz einpendelt, fällt er bei Dauerlast im Stresstest auf durchschnittlich 1759 MHz ab. Dies sieht auch bei den Spannungswerten sehr ähnlich aus: Werden anfangs noch bis zu 1,062 Volt erreicht, sinkt diese Spannung dann später auf 1,043 Volt, was guter Durchschnitt ist.

Aus diesen Spannungsverläufen und den fließenden Strömen ergibt sich dann auch die Leistungsaufnahme, die wir mit unserem exakten Equipment sehr gut an allen Anschlüssen messen können.

Da die Hersteller auf Grund von Nvidias Restriktionen auf die unterste mögliche Taktrate verzichten, um durch diesen Kunstgriff quasi einen Boost-Step mehr zu erhalten, steigt der niedrigste GPU-Takt auf 240 MHz.

Die Folgen davon zeigt die Tabelle:

| Leistungsaufnahme | |

|---|---|

| Idle | 13 Watt |

| Idle Multi-Montor | 14 Watt |

| Blu-ray | 15 Watt |

| Browser-Games | 111 bis 121 Watt |

| Gaming (Metro Last Light 4K) | 180 Watt |

| Torture (Furmark) | 183 Watt |

Natürlich wollen wir euch auch die gewohnten Detailgrafiken der Leistungsaufnahme im Idle, beim 4K-Gaming und beim Stresstest nicht vorenthalten, die sowohl die Lastverteilung auf den einzelnen Spannungs- und Versorgungsschienen abbilden als auch einen guten Überblick über die anfallenenden Lastschwankungen und Leistungsspitzen geben:

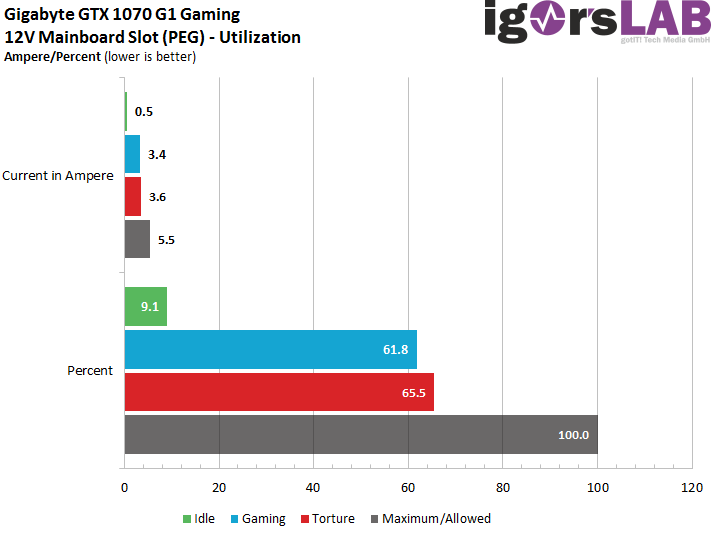

Die gemessenen, eher gemächlich anmutenden 3.6 Ampere anstelle der maximal durch die PCI SIG spezifizierten 5.5 Ampere sind wirklich beruhigend, auch beim Einsatz auf älteren Mainbords. Gigabyte lässt lediglich den Speicher über den Mainboard-Slot versorgen, während die anderen sechs Phasen für die GPU komplett über den externen dem 8-Pin-Anschluss versorgt werden.

Kühlsystem und Temperaturen

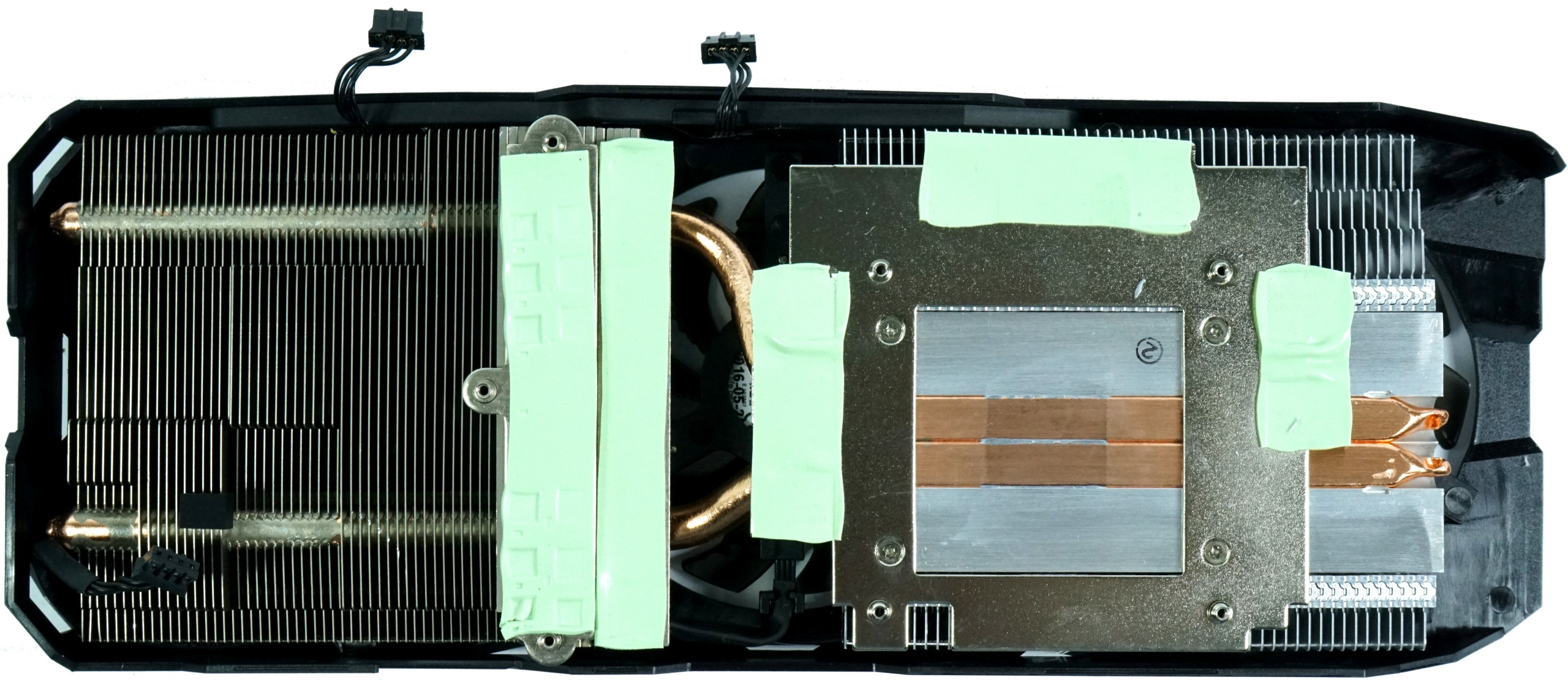

Im direkten Zusammenhang zur aufgenommenen Leistung steht natürlich die erzeugte Abwärme, für deren optimale Abführung die Kühllösung verantwortlich ist. Die Backplate kann hier leider nicht aktiv mithelfen, denn sie dient nur der Optik und Stabilisierung der Karte.

Was gut gelöst ist, sind sowohl der integrierte, zweistufig ausgeführte Heatsink für VRM und Spulen, als auch der Umstand, dass die Speichermodule direkt vom Stabiliserungsframe des sehr einfach gehaltenen Kühlers mitgekühlt werden.

Was weniger gefallen kann, ist die sehr uninspirierte und geradezu billig anmutenden Umsetzung des eigentlichen Kühlers. Ein einfacher Lamellenkühler mit dicker Aluminium-Bodenplatte, die gleichzeitig auch als Heatsink und Halterung für die beiden angeschliffenenen 8-mm-Heatpipes dient (DHT-Prinzip). Diese Heatpipes überdecken noch nicht einmal die komplette GPU und schaffen es mit sicherheit auch nur knapp, die Abwärme einigermaßen odentlich abzutransportieren. Man wäre mit drei Heatpipes sicher deutlich besser gefahren.

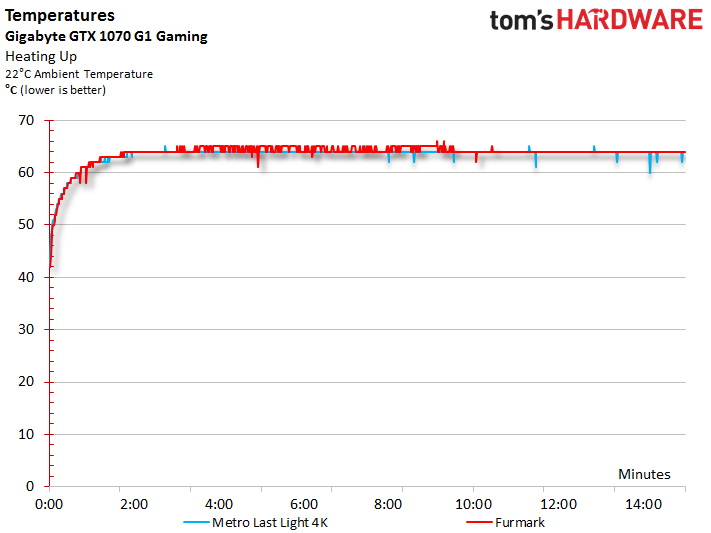

Die GPU-Temperaturen liegen mit maximal 64°C sicher noch voll im grünen Bereich, was aber weniger am Kühler selbst, sondern am sehr niedrig angesetzten Temperatur-Target liegen sollte, da nach dem Erreichen der Temperaturgrenze die Lüfter bereits recht vernehmlich agieren müssen. Doch dazu gleich mehr.

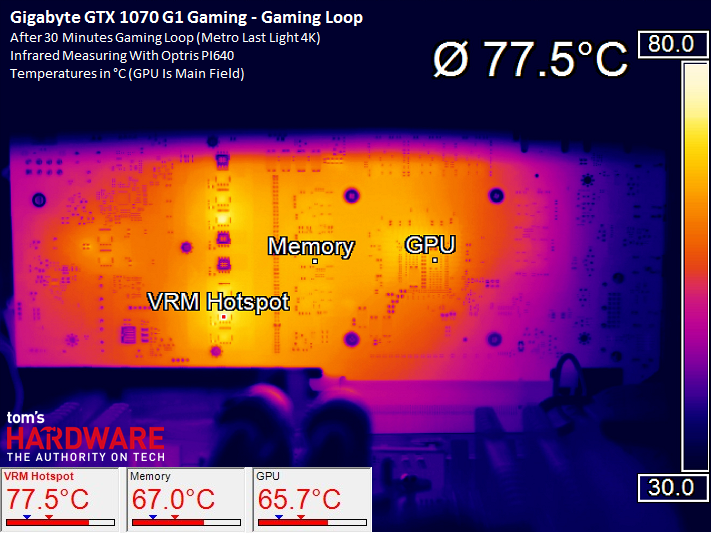

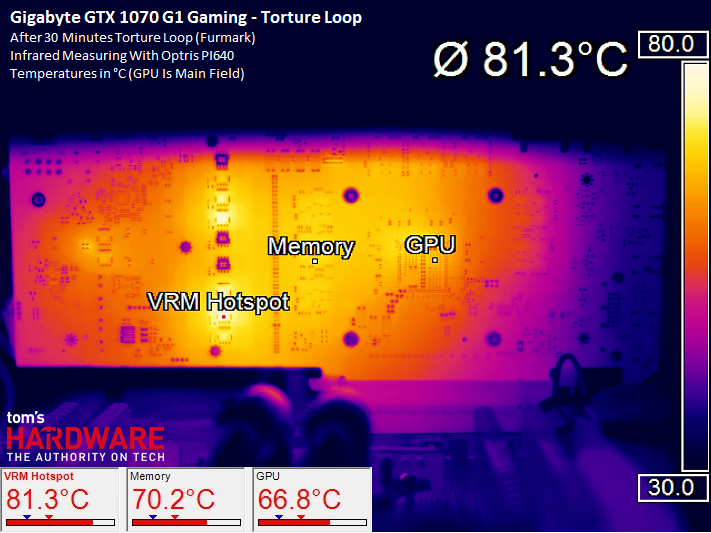

Betrachtet man zusätzlich noch die die Infrarot-Bilder der Platine, dann sieht man, dass der GPU-Sockel (und somit die Platine) leicht wärmer ist, als die gekühlte GPU selbst. Die 78°C für die Spannungswandler sind ebenfalls noch erträglich, was Dank des guten Heatsinks auch nicht verwundert.

Gleiches gilt dann auch für den Stress-Test, denn die Temperaturen steigen nur marginal an. Insgesamt betrachtet kann man die Kühlung somit als akzeptabel bezeichnen, auch wenn sie bereits deutlich an ihre Grenzen stößt.

Geräuschentwicklung

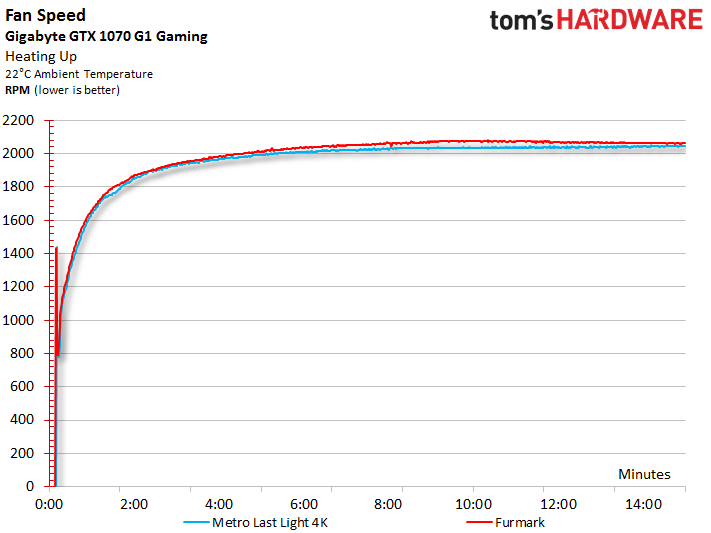

Die Hysterese ist perfekt implementiert, so dass es keinen lästigen An-Aus-An-Loop gibt. Permanente Drehzahlen über 2000 U/min sind dann aber kein wirklicher Grund zur Freude mehr, denn man hört es deutlich.

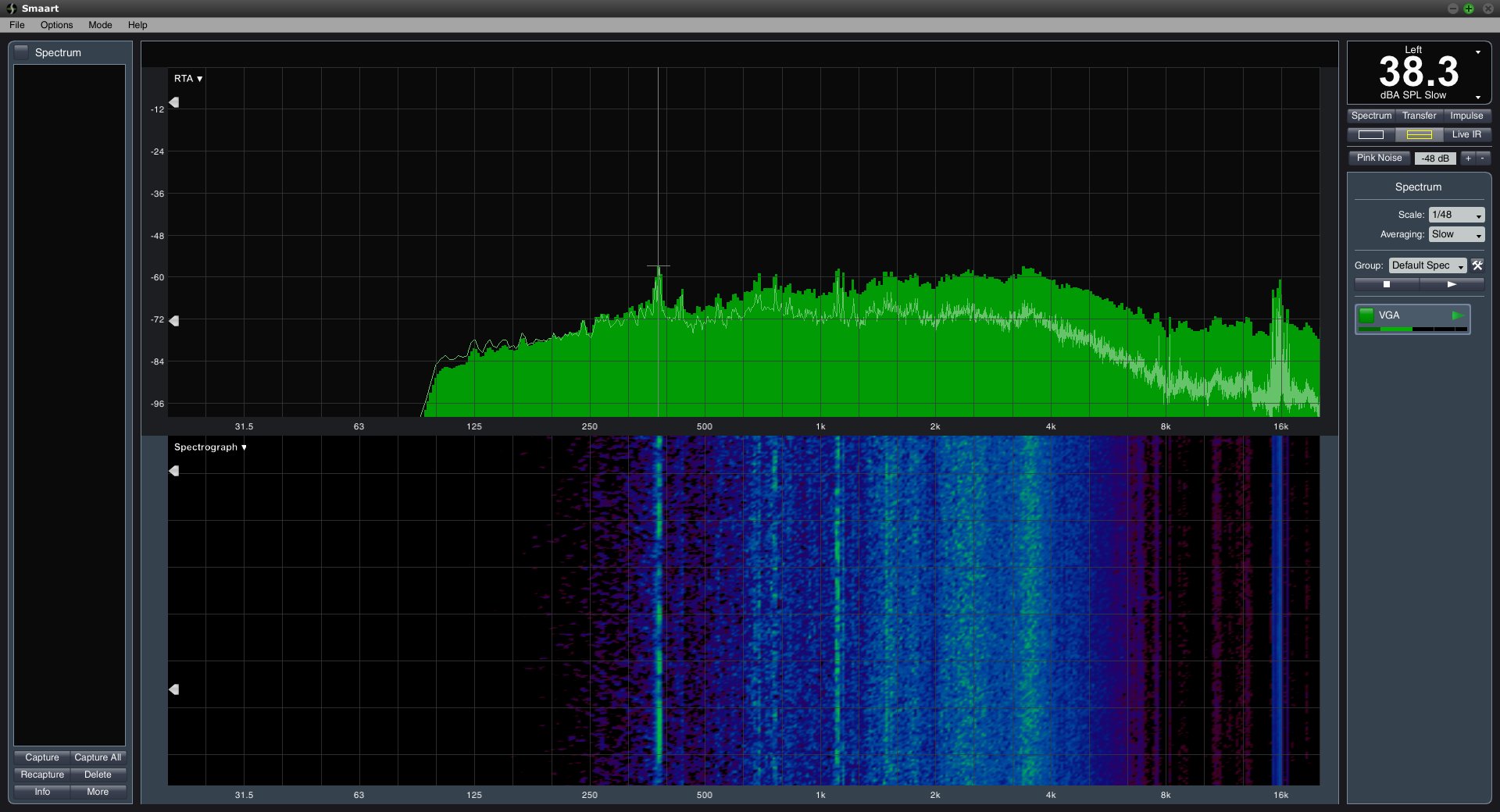

Mit 38.3 dB(A) bei Volllast ist es als Gesamtkunstwerk zwar noch kein Taifun, aber doch deutlich lauter als viele andere GeForce GTX 1070, was eigentlich unnötig ist.

Technische Daten und Zwischenfazit

Betrachten wir nun noch einmal zusammenfassend die technischen Daten und individuellen Details der Grafikkarte:

- 1 - Einführung und Übersicht

- 2 - Asus GeForce GTX 1070 Strix OC

- 3 - EVGA GeForce GTX 1080 FTW

- 4 - Gigabyte GeForce GTX 1070 Mini ITX OC

- 5 - Gigabyte GeForce GTX 1070 G1 Gaming

- 6 - Gigabyte GeForce GTX 1080 G1 Gaming

- 7 - Gigabyte GeForce GTX 1080 Xtreme Gaming

- 8 - KFA²/Galax GeForce GTX 1070 EX

- 9 - KFA²/Galax GeForce GTX 1080 HoF (Hall of Fame)

- 10 - MSI GeForce GTX 1070 Gaming X 8G

- 11 - MSI GeForce GTX 1080 Gaming X 8G

- 12 - MSI GeForce GTX 1080 Sea Hawk

- 13 - Nvidia GeForce GTX 1070 Founders Edition

- 14 - Nvidia GeForce GTX 1080 Founders Edition

- 15 - Palit GeForce GTX 1070 Game Rock Premium Edition

- 16 - Palit GeForce GTX 1080 Game Rock Premium Edition

- 17 - PNY GeForce GTX 1080 XLR8

- 18 - Zotac GeForce GTX 1080 AMP! Extreme

- 19 - Vergleich der Gaming-Performance

- 20 - Vergleich vom Temperatur, Lautstärke und Leistungsaufnahme

Kommentieren