Leistungsaufnahme und Temperaturen

Ich hatte es ja bereits geschrieben, dass man die SSDs fast schon ungekühlt nutzen kann. Im Leerlauf sind es rund 700 mW, die ich am Adapter messen kann. Im Normalmodus (Workstation-Workloads, Gaming) genehmigt die die gesamte SSD keine 2,5 Watt, was ein absoluter Spitzenwert für eine PCIe-4-SSD ist. Die maximal 4.43 Watt im Peak (typisch 3,8 bis 4 Watt) beim Dauerkopieren sind auch nichts, was einem Angst einflößen dürfte. Das thermische Throttling soll bei rund 90 °C einsetzen, aber das konnte ich selbst ohne Kühler nicht einmal ansatzweise erreichen. Bei rund 68 °C im Stresstest war Schluss mit der weiteren Erhitzung und normal sind es beim Gaming keine 45 °C. Ohne Kühler wohlgemerkt. Allein durch eine einfache, rückseitigen Kühlung, fällt die Temperatur um bis zu 9 Grad.

Controller und NAND-Speicher

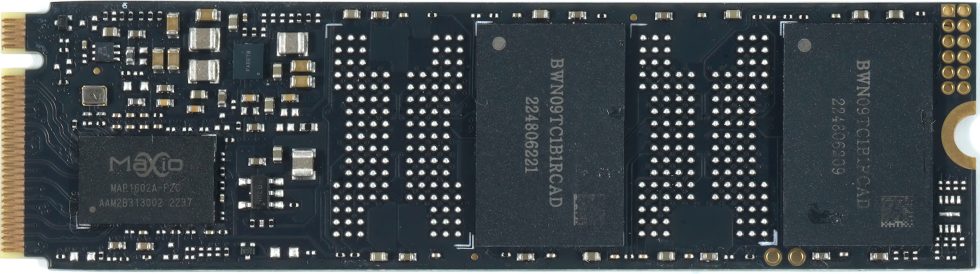

Biwin setzt als Controller auf einen MAP1602A von Maxio. Hierbei handelt es sich um eine Ausgründung von JMicron, die seinerzeit auch schon einmal diverse SSD-Controller hergestellt hatten. Dieser hochinteressante Controller setzt bereits auf den 12-nm- Node von TSMC und einen ARM Cortex-R5-Kern samt Co-Prozessoren. Er verfügt über vier Kanäle und ist komplett DRAM-frei, was letztendlich auch zu Effizienzsteigerung beiträgt. Im Gegensatz zu anderen DRAM-losen PCIe 4.0-Controllern, wie Letztens auf der von mir getesteten Corsair MP600 GS, verfügt dieser über einen 2400 MT/s-Bus, was wohl ebenfalls noch der Effizienz zu gute kommen sollte und Phison durchaus ärgern dürfte.

Zum Controller ist nicht viel bekannt, aber unterstützt er sowohl Trim- als auch S.M.A.R.T.. Wie andere Controller auch, nutzt er Active State Power Management (ASPM), Autonomous Power State Transition (APST) und den L1.2 Ultra-Low-Power-Status. Eine thermische Drosselung ist implementiert, ist aber nicht weiter von Belang, da der Controller in den meisten Anwendungsfällen nicht zu heiß wird. Das erkennt man auch daran, dass man im Gegensatz zu vielen anderen Modellen auf einen integrierten Nickel-Kühlkörper verzichten kann. Viel mehr an Daten bekommt man aber leider nicht, denn die öffentliche Zugänglichkeit der Informationen ist schon arg limitiert.

Ich schrieb es ja schon mehrmals, dass die SSD auf einen dedizierten DRAM-Cache verzichten muss. Sie greift stattdessen via Host-Memory-Buffer (ab Windows 10) auf den normalen System-RAM des Rechners zu. Das kann man durchaus machen, denn im Normalfall reicht selbst dieses standardmäßige NVMe-Feature, um das Fehlen eines eigenen DRAM-Caches auszugleichen. Was da aber sporadisch passieren kann, werden wir beim AJA-Streaming gleich noch sehen.

Der Maxio Controller kommuniziert mit dem NAND über vier sehr schnelle NAND-Flash-Kanäle mit bis zu 2400 MTps (normal sind 1600 MTps) und unterstützt Kapazitäten von bis zu 4 TB. Unser Muster enthält einseitig zwei NAND-Module. Dieser von Biwin gebinnte und gelabelte Flash ist 3D-TLC von YMTC. Die vierlagige 128-Layer-Variante auf meiner SSD ist nicht einmal die neueste Ausbaustufe, aber diverse politische Spielereien verhindern wohl momentan, dass man den Platzhirschen wie Micron mit eigenem (und noch effizienterem) 232-Layer RAM gefährlich werden könnte. Nur gehören solche Diskussionen nicht hierher. Aber es ist schon ärgerlich. MAGA und so…

Dieser Flash verfügt zumindest über die ältere Xtacking-Technologie und hat als neuere Iteration auch schon ein anderes 2×2-Layer-Layout als das ursprüngliche 128-Layer-Design. Es handelt sich genau genommen um eine bekannte Wafer-on-Wafer-Technologie, um separate CMOS-Schaltkreise auf einem umgedrehten Flash-Array (FlipChip) zu verbinden. Gewisse andere Flash-Hersteller setzen die CMOS stattdessen unter das Speicherarray. Das Design von YMTC bietet zudem Vorteile in Bezug auf die Chipdichte und die Effizienz, ist aber etwas in der Produktion dadurch auch deutlich aufwändiger.

Was bedeutet eigentlich dynamischer pSLC Cache?

Kommen wir nun zu einem etwas technischeren Detail, das den meisten so gar nicht im vollen Umfang bekannt sein dürfte. Über pSLC-Cache ist ja schon viel geschrieben worden, das muss man gar nicht noch einmal im Detail durchkauen, maximal noch als kleine Auffrischung. Here we go…

Um die Schreibgeschwindigkeit zu erhöhen, wird gern der sogenannte “Pseudo-SLC Cache” (pSLC) in Consumer-Produkten genutzt, wobei man ihn mittlerweile auch in diversen industriellen Lösungen findet. Hierfür wird ein Teil der NAND-Kapazität als SLC-Speicher konfiguriert, in dem nur ein Bit pro Zelle gespeichert wird. Dementsprechend kann dieser Speicher sehr schnell beschrieben und gelesen werden. Da es sich nicht um dedizierten, also keinen echten SLC-Speicher handelt, wird er pseudo SLC genannt. Ein solcher Cache kann für alle Speichertypen verwendet werden, die mehrere Bits pro Flash-Zelle speichern, also wie hier beim TLC drei Bits. Der pSLC Cache nutzt bei dem einen Bit zudem eine deutlich höhere Spannung, was eine gewisse Sicherheit bietet und damit besser ist als Fast Page.

Die Verwendung von pSLC-Cache bietet einen Geschwindigkeitsvorteil, vor allem dann, wenn das Speichermedium nicht mit Lese- oder Schreibzugriffen zwischen dem dem Schreiben größerer Datenmengen beschäftigt ist. Diese Leerlaufzeiten werden vom Speichermedium genutzt, um Daten aus dem Cache in den TLC-Bereich zu verschieben.

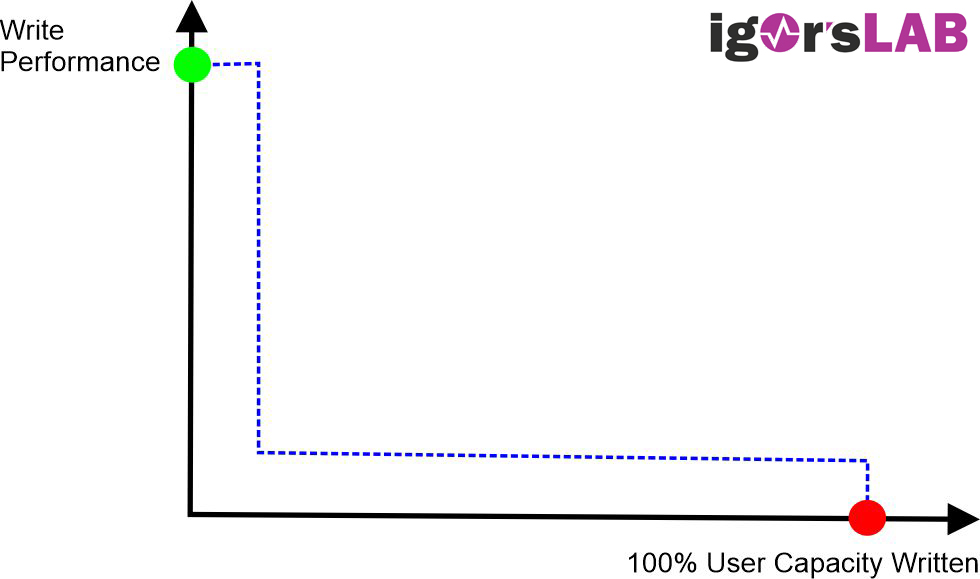

Doch die Nachteile des pSLC kennt jeder. Wenn der schnelle pSLC-Cache nämlich voll ist, sinkt die Geschwindigkeit deutlich ab, da weitere Schreibzugriffe auf das auf das Speichermedium erst den pSLC freimachen müssen, indem man ältere Daten aus dem Cache in den TLC Speicher verschiebt.

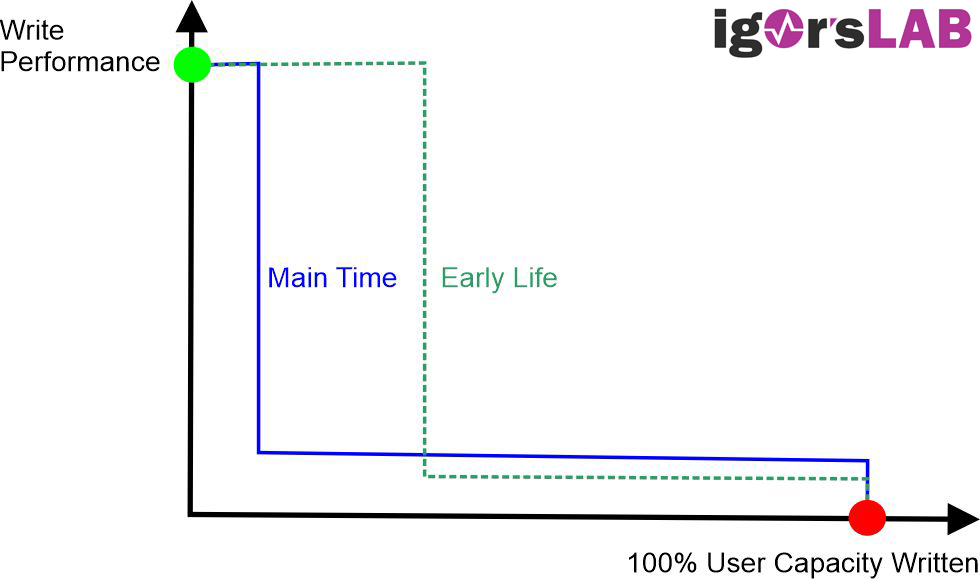

Doch was bitte versteckt sich jetzt hinter “dynamischem pSLC Cache”? Dynamischer pSLC-Cache hat zwar mittlerweile auch seinen Weg in industriellen Speicherlösungen gefunden, aber nur mit sehr harten Einschränkungen. Im Gegensatz zum statischen pSLC-Cache werden bis zu 100 % des NAND-Flash dynamisch als pSLC-Cache genutzt, je nachdem, wie voll das Speichermedium ist. Der Cache kann also bis zu 1/3 der Gesamtspeichergröße umfassen

Die Schreibgeschwindigkeit des Speichermediums hängt allerdings nicht nur von der Datenmenge ab, die ohne Unterbrechung geschrieben wird, sondern auch vom Füllstand des Speichers. Und genau das macht die Schreibgeschwindigkeit im Lebenszyklus nur schwer vorhersagbar.

Von einer dynamischen Änderung der Konfiguration von Flash-Blöcken als pSLC- oder TLC-Speicher wird von den NAND-Flash-Herstellern aus Gründen der Zuverlässigkeit zwar abgeraten, aber im Consumer-Bereich, wo die Temperaturfenster nicht so sehr von Belang sind, sieht man das durchaus etwas entspannter.

Alle Hersteller von dynamischen NAND-Speichermedien Medien, auch Micron, wechseln nach einer festgelegten Maximalanzahl von Programm- und Löschzyklen dauerhaft in den TLC-Modus zurück. Davor erreicht das Speichermedium die besten Werte vor allem bei kurzen Schreibvorgängen, die nicht die gesamte Kapazität benötigen. Nach einer gewissen Nutzungszeit wird das Medium jedoch dauerhaft verlangsamt, das darf man nie ausblenden. Der E18 von Phison beherrscht die dynamische Änderung der Konfiguration von Flash-Blöcken recht gut, aber die Physik überlisten kann er auch nicht.

Wann man dann das Ende der tollen Cache-Performance erreichen wird, ist hier so ein Ding mit Unwägbarkeiten. Nach reichlich 75 GB im Stück war erst einmal Schluss mit der Herrlichkeit und bei etwas mehr als 80% der Kapazität liegt man nur noch auch mittelmäßigem SATA-Niveau. Das wird man in der Praxis so zwar kaum hinbekommen, aber im Stück vollzuschreiben und das vielleicht auch öfters, sollte man besser lassen.

13 Antworten

Kommentar

Lade neue Kommentare

Urgestein

Veteran

Urgestein

Urgestein

1

Veteran

Urgestein

Neuling

Mitglied

Urgestein

Mitglied

Urgestein

Urgestein

Alle Kommentare lesen unter igor´sLAB Community →