RTX on! Das war ein großes Thema 2018. Die Verfügbarkeit in Spielen war anfangs noch überschaubar, aber mittlerweile hat es sich etabliert und die Spieleentwickler implementieren diese Technologien zunehmend. Da die Echtzeitberechnung (Raytracing) sehr viel Leistung kostet, hat sich Nvidia mit DLSS, das haben wir ja gerade sehen können. Doch es gibt ja nicht nur DLSS für das Mehr an FPS, sondern auch Latenzprobleme, die man lösen wollte. NVIDIA Reflex soll nun den Knoten in der Render-Pipeline auflösen, sodass sich die Latenzen (ähnlich wie bei einem Frame-Limiter) im GPU-Limit deutlich verringern.

Was NVIDIA Reflex und Boost nun in der Praxis wirklich bringen, hatten wir ja bereits sehr ausführlich thematisiert. Nachmessen im Selbstversuch war angesagt. Dazu findet ihr auf der Homepage unter dem Schlagwort “Reflex” und hier um unten verlinkten Artikel noch weiteren Lesestoff zum Thema Latenzen, Reflex etc. Ich denke, dass das ausreichend sein sollte, um DLSS 3.0 vollumfänglich einzuordnen. Das Wesentliche sind die zusätzlichen Frames in Verbindung mit Reflex, denn die Super Resolution kennen wir ja schon.

Reflex mit und ohne DLSS 3.0

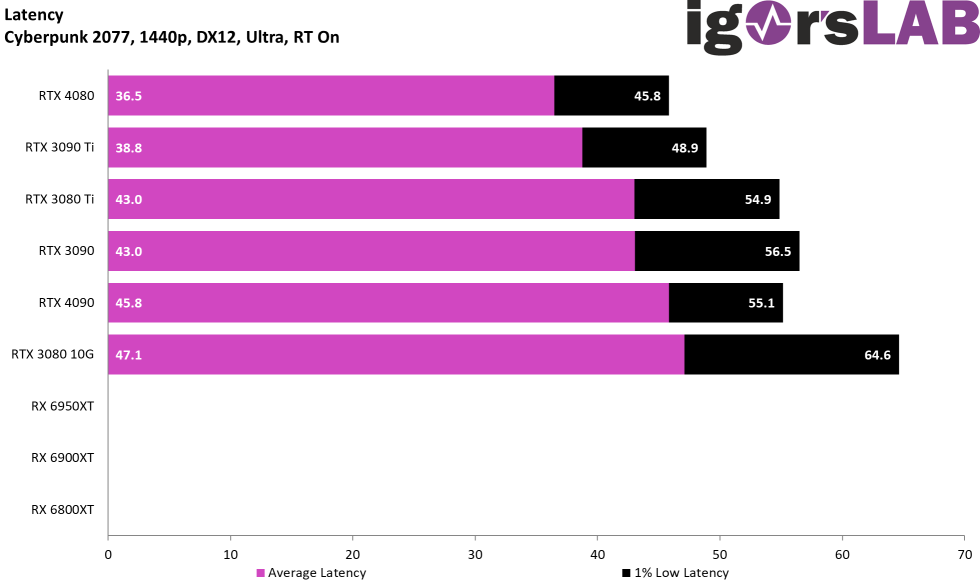

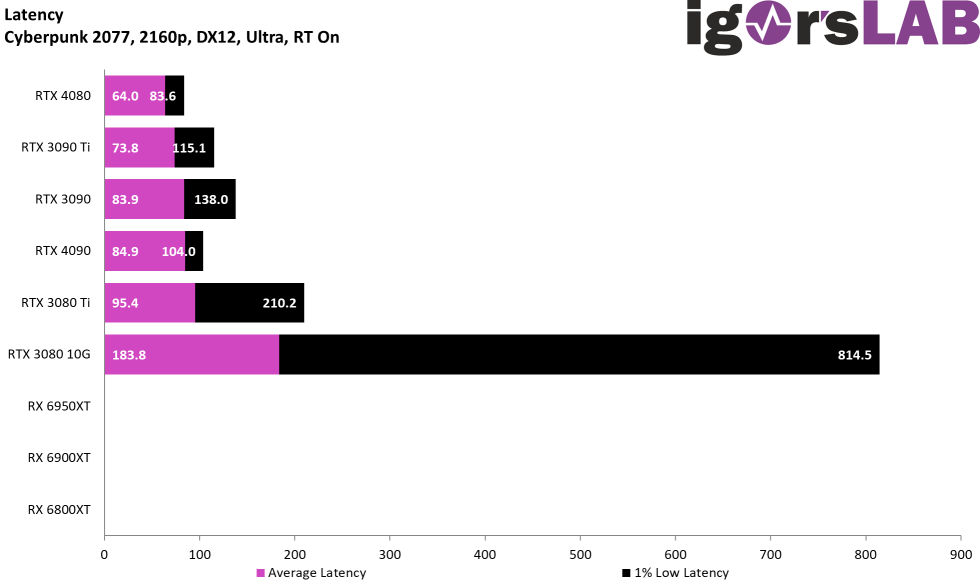

Nachdem wir ja in der Lage sind, die system-Latenzen mittels unseres Equipments zu messen, gibt es seit Kurzem auch die Möglichkeit, zumindest die NVIDIA-Karten mittels NVIDIA FrameView auch per Software während des Benchmarks auszulesen. Genau dafür habe ich jetzt noch ein paar abschließende Benchmarks für Euch, die sowohl ohne DLSS, als auch mit DLSS 2.3 sowie DLSS 3.0 gemacht wurden. Zunächst die Latenzen ohne DLSS, wobei sich die GeForce RTX 4080 als kleine Latenzkönigin entpuppt.

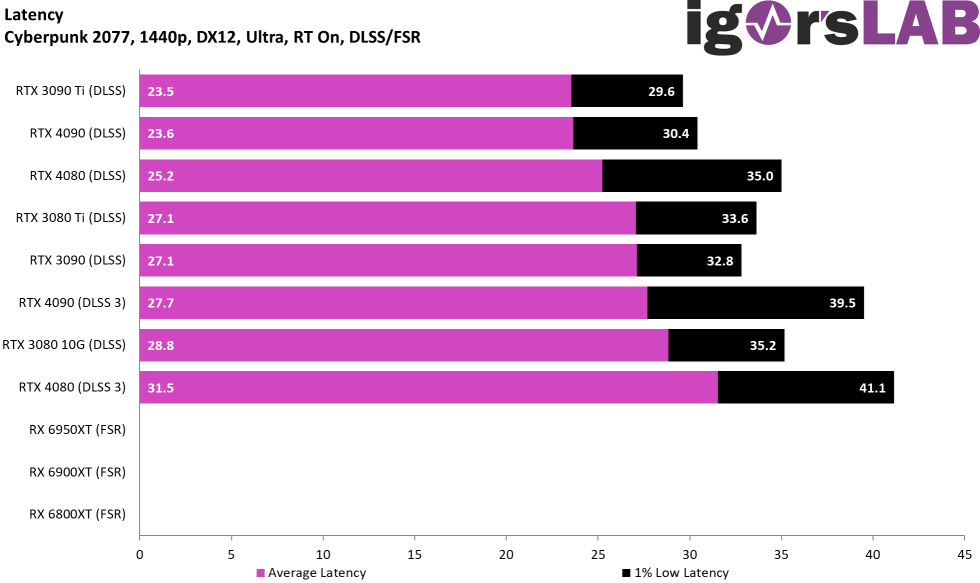

Jetzt nehmen wir DLSS hinzu, wobei das Erzeugen der hochgerechneten Zwischenframes aktuell nur auf den RTX 4000 Karten funktioniert. in QHD limitiert ganz offensichtlich die CPU, so dass sich die Zeit, die für die Frame-Berechnung durch die KI benötigt wird, nicht negativ im Ergebnis niederschlägt.

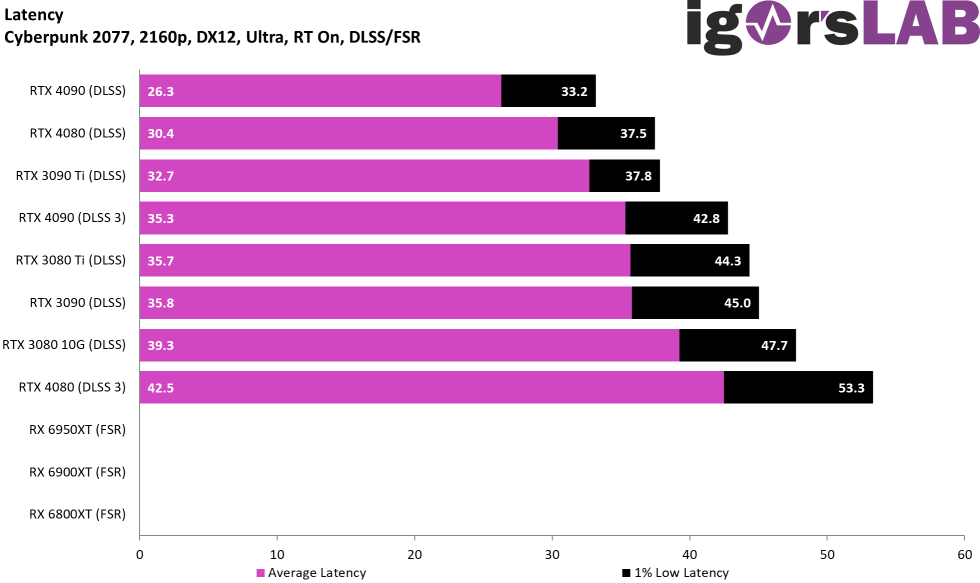

Vergleich man jedoch in Ultra HD die Ergebnisse der GeForce RTX 4090 von DLSS ohne und DLSS 3.0 mit der Zwischenframe-Berechnung, dann sehen wir exakt die gewissen 10 bis 15 ms, die diese Generierung der zusätzlichen Inhalte mittels KI nun einmal dauert. Hier liegen wir also genau auf dem Wert, denn NVIDIA uns auch kommuniziert hatte.

Damit schließe ich das heutige Kapitel zu DLSS 3.0 und den weiteren neuen Features ab, verweise aber noch einmal auf die große Artikel-Reihe, die morgen beginnt. Dann gibt es nämlich Ein- und Ausblicke, die Ihr so in diesem Umfang sicher noch nicht gesehen habt. Da die Menge der Daten aber den Rahmen so eines Launchartikels wie des heutigen sprengt, musste es einfach geteilt werden. Vorteil: auch morgen gibt es einen hochinteressanten und langen Artikel zu lesen 🙂

- 1 - Einführung, technische Daten und Technologie

- 2 - Test System im igor'sLAB MIFCOM-PC

- 3 - Teardown: Platine und Kühler

- 4 - Gaming-Performance WQHD (2560 x 1440 Pixel)

- 5 - Gaming-Performance UHD (3840 x 2160 Pixel)

- 6 - Gaming-Performance UHD + DLSS/FSR/XeSS (3840 x 2160 Pixel)

- 7 - DLSS 3.0 und die längsten Balken

- 8 - NVIDIA Reflex und Latenzen

- 9 - Workstation Grafik und Rendering

- 10 - Leistungsaufnahme und Lastverteilung

- 11 - Lastspitzen, Kappung und Netzteilempfehlung

- 12 - Temperaturen, Taktraten, Lüfter und Lautstärke

- 13 - Zusammenfassung und Fazit

168 Antworten

Kommentar

Lade neue Kommentare

Urgestein

Veteran

1

Veteran

Mitglied

Urgestein

Veteran

Moderator

Veteran

Urgestein

Mitglied

Veteran

Urgestein

Veteran

Veteran

Neuling

Urgestein

Urgestein

Alle Kommentare lesen unter igor´sLAB Community →